简介

hive是facebook开源,并捐献给了apache组织,作为apache组织的顶级项目(hive.apache.org)。 hive是一个基于大数据技术的数据仓库(DataWareHouse)技术,主要是通过将用户书写的SQL语句翻译成MapReduce代码,然后发布任务给MR框架执行,完成SQL 到 MapReduce的转换。可以将结构化的数据文件映射为一张数据库表,并提供类SQL查询功能。

总结

Hive是一个数据仓库(数据库)

Hive构建在HDFS上,可以存储海量数据。

Hive允许程序员使用SQL命令来完成数据的分布式计算,计算构建在yarn之上。(Hive会将SQL转化为MR操作)

优点:

简化程序员的开发难度,写SQL即可,避免了去写mapreduce,减少开发人员的学习成本

缺点:

延迟较高(MapReduce本身延迟,Hive SQL向MapReduce转化优化提交),适合做大数据的离线处理(TB PB级别的数据,统计结果延迟1天产出)

Hive不适合场景:

1:小数据量, MySQL。

2:实时计算:Spark HBase

数据库 DataBase

数据量级小,数据价值高

数据仓库 DataWareHouse

数据体量大,数据价值低

Hive 的架构

1. 简介

HDFS:用来存储hive仓库的数据文件 yarn:用来完成hive的HQL转化的MR程序的执行 MetaStore:保存管理hive维护的元数据 Hive:用来通过HQL的执行,转化为MapReduce程序的执行,从而对HDFS集群中的数据文件进行统计。2. 图

Hive的安装

# 步骤 1. HDFS(Hadoop2.9.2) 2. Yarn(Hadoop2.9.2) 3. MySQL(5.6) 4. Hive(1.2.1)虚拟机内存设置为1G

1. 安装mysql数据库

参考MySQL安装文档

2. 安装Hadoop

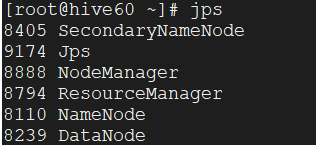

# 配置hdfs和yarn的配置信息 [root@hive40 ~]# jps 1651 NameNode 2356 NodeManager 2533 Jps 1815 DataNode 2027 SecondaryNameNode 2237 ResourceManager3. 安装hive

1 上传hive安装包到linux中

2 解压缩hive

[root@hadoop ~]# tar -zxvf apache-hive-1.2.1-bin.tar.gz -C /opt/installs [root@hadoop ~]# mv apache-hive-1.2.1-bin hive1.2.13 配置环境变量

export HIVE_HOME=/opt/installs/hive1.2.1 export PATH=$PATH:$HIVE_HOME/bin4 加载系统配置生效

[root@hadoop ~]# source /etc/profile5 配置hive

hive-env.sh

拷贝一个hive-env.sh:[root@hadoop10 conf]# cp hive-env.sh.template hive-env.sh# 配置hadoop目录 HADOOP_HOME=/opt/installs/hadoop2.9.2/ # 指定hive的配置文件目录 export HIVE_CONF_DIR=/opt/installs/hive1.2.1/conf/hive-site.xml

拷贝得到hive-site.xml:[root@hadoop10 conf]# cp hive-default.xml.template hive-site.xml<?xml version="1.0" encoding="UTF-8" standalone="no"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!--hive的元数据保存在mysql中,需要连接mysql,这里配置访问mysql的信息--> <!--url:这里必须用ip--> <property> <name>javax.jdo.option.ConnectionURL</name> <value>jdbc:mysql://192.168.199.40:3306/hive</value> </property> <!--drivername--> <property> <name>javax.jdo.option.ConnectionDriverName</name> <value>com.mysql.jdbc.Driver</value> </property> <!--username--> <property> <name>javax.jdo.option.ConnectionUserName</name> <value>root</value> </property> <!--password--> <property> <name>javax.jdo.option.ConnectionPassword</name> <value>admins</value> </property> </configuration>登录mysql创建hive数据库(使用命令行创建)

create database hive复制mysql驱动jar到hive的lib目录中

4 启动

1. 启动 hadoop

启动hadoop

# 启动HDFS start-dfs.sh # 启动yarn start-yarn.sh

2. 本地启动hive

初始化元数据:schematool -dbType mysql -initSchema初始化mysql的hivedatabase中的信息。

3. 启动Hive的两种方式

# 本地模式启动 # 启动hive服务器,同时进入hive的客户端。只能通过本地方式访问。 [root@hadoop10 ~]# hive# 服务器模式启动 # 之启动hive的服务器,可以允许远程连接方式访问。 # 前台启动 hiveserver2 # 后台启动 hiveserver2 &启动本地hive并进入客户端模式(管理员模式)

[root@hadoop40 installs]# hive Logging initialized using configuration in jar:file:/opt/installs/hive1.2.1/lib/hive-common-1.2.1.jar!/hive-log4j.properties hive># 1. 客户端操作之dfs命令

1. 查看dfs中的文件。 dfs -ls /; 2. 查看dfs中 /user 下的文件 dfs -ls /user; 3. 以递归的方式,查看/user下的所有文件 dfs -lsr /user;# 2.客户端操作之HQL(Hive Query language)

# 1.查看数据库 hive> show databases; # 2. 创建一个数据库 hive> create database baizhi; # 3. 查看database hive> show databases; # 4. 切换进入数据库 hive> use baizhi; # 5.查看所有表 hive> show tables; # 6.创建一个表 hive> create table t_user(id string,name string,age int); # 7. 添加一条数据(转化为MR执行--不让用,仅供测试) hive> insert into t_user values('1001','yangdd'); # 8.查看表结构 hive> desc t_user; # 9.查看表的schema描述信息。(表元数据,描述信息) hive> show create table t_user; # 明确看到,该表的数据存放在hdfs中。 # 10 .查看数据库结构 hive> desc database baizhi; # 11.查看当前库` hive> select current_database(); # 12 其他sql select * from t_user; select count(*) from t_user; (Hive会启动MapReduce) select * from t_user order by id;3.hive的客户端和服务端

# 启动hive服务端 // 前台启动 [root@hadoop40 ~]# hiveserver2 // 后台启动 [root@hadoop40 ~]# hiveserver2 &beeline客户端

# 启动客户端 [root@hadoop40 ~]# beeline beeline> !connect jdbc:hive2://hadoop40:10000 回车输入mysql用户名 回车输入mysql密码JDBC

# 导入依赖<dependency> <groupId>org.apache.hive</groupId> <artifactId>hive-jdbc</artifactId> <version>1.2.1</version> </dependency> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-common</artifactId> <version>2.9.2</version> </dependency># JDBC操作Hivepublic static void main(String[] args) throws Exception { BasicConfigurator.configure();//开启日志 //加载hive驱动 Class.forName("org.apache.hive.jdbc.HiveDriver"); //连接hive数据库 Connection conn = DriverManager.getConnection("jdbc:hive2://192.168.199.40:10000/baizhi","root","admins"); String sql = "select * from t_user1"; PreparedStatement pstm = conn.prepareStatement(sql); ResultSet rs = pstm.executeQuery(); while(rs.next()){ String id = rs.getString("id"); String name = rs.getString("name"); int age = rs.getInt("age"); System.out.println(id+":"+name+":"+age); } rs.close(); pstm.close(); conn.close(); }4. 数据类型

数据类型(

primitive,array,map,struct)

primitive(原始类型):

hive数据类型 字节 备注 TINYINT 1 java-byte 整型 SMALLINT 2 java-short 整型 INT 4 java-int 整型 BIGINT 8 java-long 整型 BOOLEAN 布尔 FLOAT 4 浮点型 DOUBLE 8 浮点型 STRING 字符串 无限制 VARCHAR 字符串 varchar(20) 最长20 CHAR 字符串 char(20) 定长20 BINARY 二进制类型 TIMESTAMP 时间戳类型 DATE 日期类型 array(数组类型):

# 建表 create table t_tab( score array<float>, 字段名 array<泛型> );map(key-value类型):MAP <primitive_type, data_type>

# 建表 create table t_tab( score map<string,float> );struct(结构体类型):STRUCT <col_name:data_type, ...>

# 建表 create table t_tab( info struct<name:string,age:int,sex:char(1)>, 列名 struct<属性名:类型,属性名:类型> );,根据以上类型构建一个表结构create table t_person( id int , name string, salary double, birthDay date, sex char(1), hobbies array<string>, cards map<string,string>, addr struct<zipCode:string,city:string> );注意 hive在建表时没有约束条件# 1.查看上述表结构desc t_person;# 2.查看表结构的详细信息show create table t_person;# 3.查看表结构的更加详细信息desc formatted t_perso