信源 (连续 离散 有记忆 无记忆)

马尔科夫信源(齐次)

当信源的记忆长度为m+1时,该时刻发出的符号与前m个符号有关联性,而与更前面的符号无关

以下默认为离散信源

信息量(自,联合,条件,彼此关系)

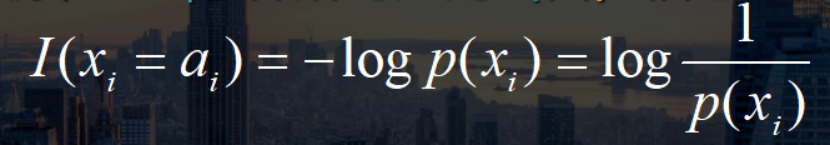

自信息量:

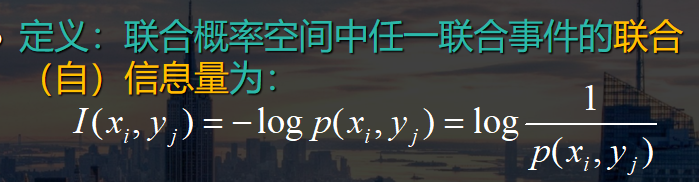

联合自信息量:

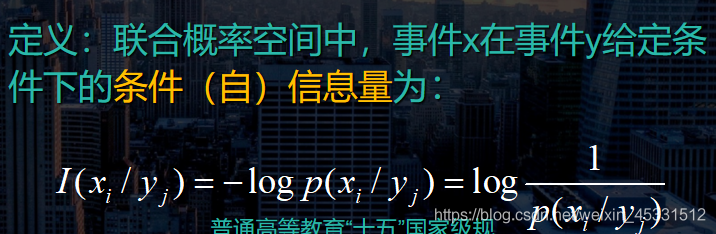

条件自信息量:

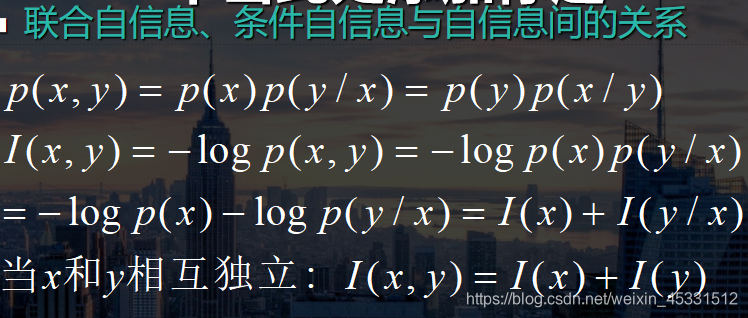

相互之间的关系:

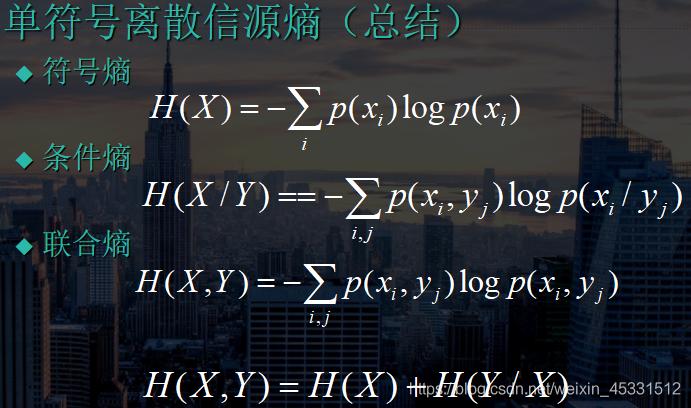

熵(条件,联合,符号,相对)

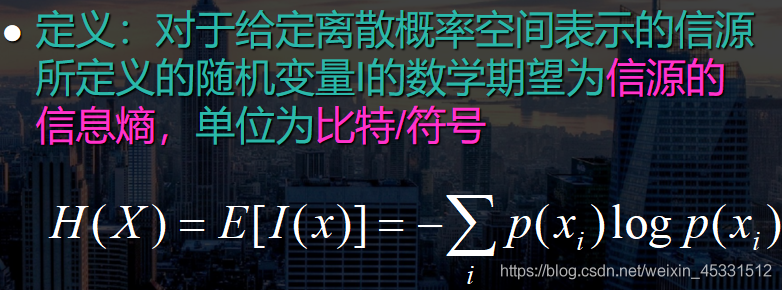

信息熵(平均信息量):

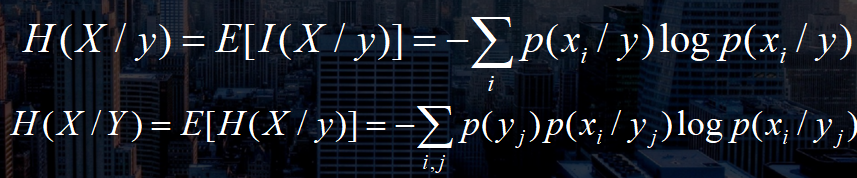

条件熵:

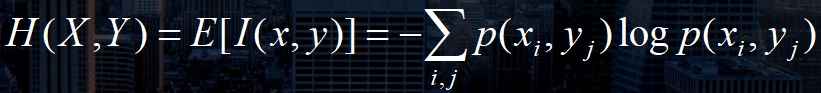

联合熵:

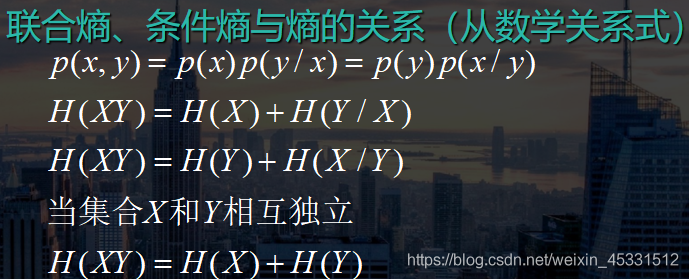

彼此关系:

总结:

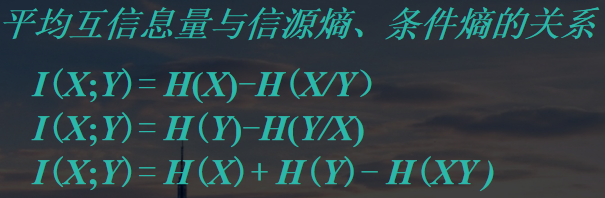

互信息 (平均,与信息熵条件熵的关系,联合,条件互信息量)

互信息:H(X)-H(X/Y)= I(X;Y)= I(Y;X)=H(Y)-H(Y/X)

彼此关系:

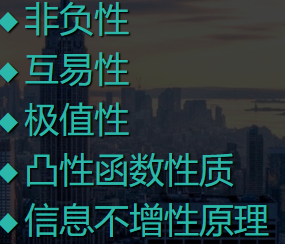

平均互信息量性质

性质不拓展

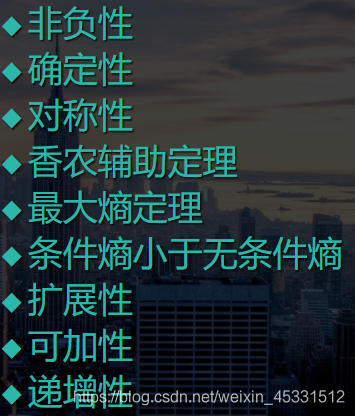

熵的性质

最大熵(总结)

无约束条件的最大熵不存在

限峰功率最大熵

限平均功率最大熵

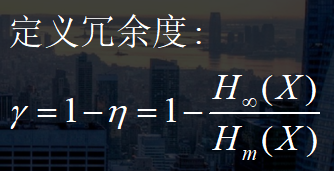

冗余度

ppt总结,便于复习。

ppt链接

链接:https://pan.baidu.com/s/1r7d3-LwCAKOZwZHgYDmDkg

提取码:1tjc

版权声明:本文为weixin_45331512原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。