在CNN中我们通常会使用3×3、5×5、7×7等奇数的卷积核,而很少见过使用2×2、4×4等偶数的卷积核的,这是为什么呢?

原因如下:

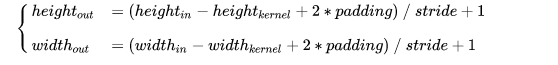

1.在对图像进行卷积时,为了尽量的减少特征的损失。此时对图像进行卷积,使得卷积前后的图像的大小同输入一样保持不变。故我们需要进行padding。现在我们设输入图像的大小为n×n,卷积核大小为k×k,padding的大小就为(k-1)/2,根据卷积公式:

可计算出卷积后的图片尺寸大小为:

(n-k+2(k-1)/2)/1+1*

故最终的输出大小还是n×n,这样就保证了卷积前后尺寸不变。

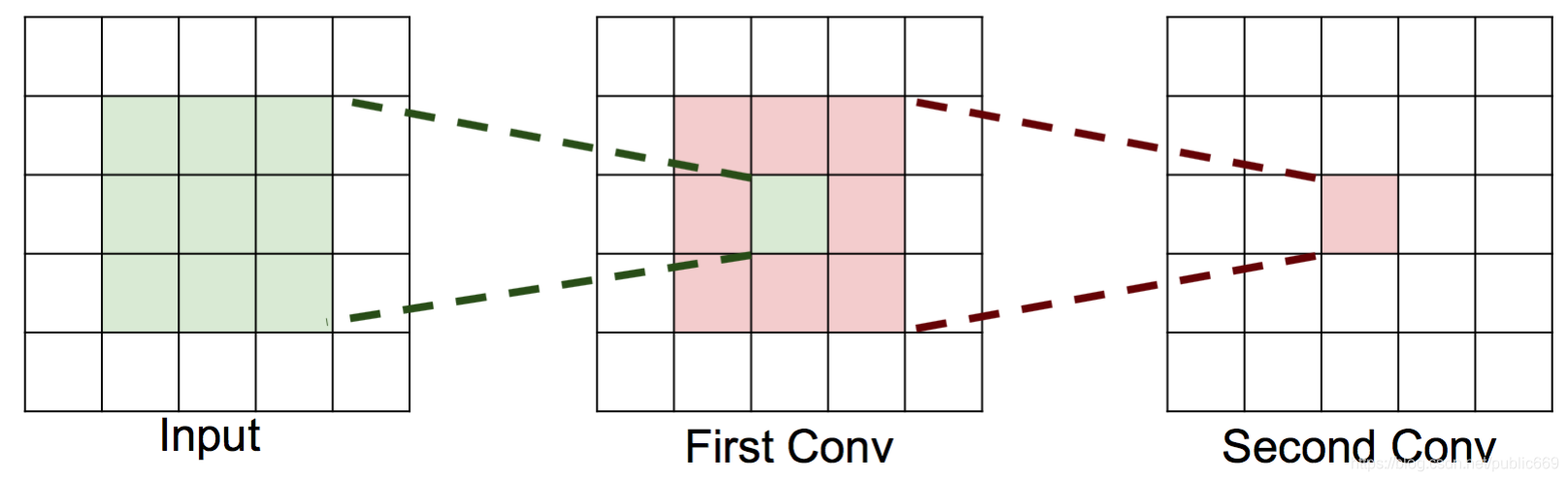

例如此时我们采用卷积核为偶数,那么(k-1)/2就不是整数了。2 .在CNN中,进行卷积时,卷积核是方形的,为了统一标准,会用卷积核模块中心为基准进行滑动,从被卷积矩阵第一个框按一定步长从左到右、从上到下进行滑动,最后滑动到被积矩阵最后一块。所以卷积核一般为奇数,主要是方便以模块中心为标准进行滑动卷积。

3 .采用卷积核为奇数可以强调中心,使得特征的损失减小;能更好地获取到中心的概念信息。

4 .奇数卷积核对边沿、对线条更加敏感,可以更有效的提取边沿信息。当然偶数也可以使用,但是效率比奇数低。在数以万计或亿计的计算过程中,每个卷积核差一点,累计的效率就会差很多了。

版权声明:本文为public669原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。