项目场景:利用flume监控文件并上传到hdfs上面出现的问题

问题一

问题描述:

在启动flume进⾏⽇志采集时出现下面的问题:HDFSEventSink.java:459

原因分析:

这个问题是因为在flume的jar包里面guava的jar包版本过低导致的,将hadoop下面的lib路径下的高版本的这个jar包复制到flume的lib路径下,然后删除以前的版本文件即可

解决方案:

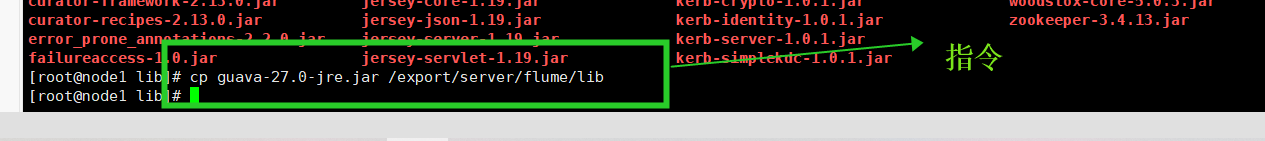

- 1、进入hadoop的lib路径下,将图中框出的文件复制到flume目录的lib路径下:

- 复制指令:

- 复制之后进入目录将原来的11的版本删除

问题二、

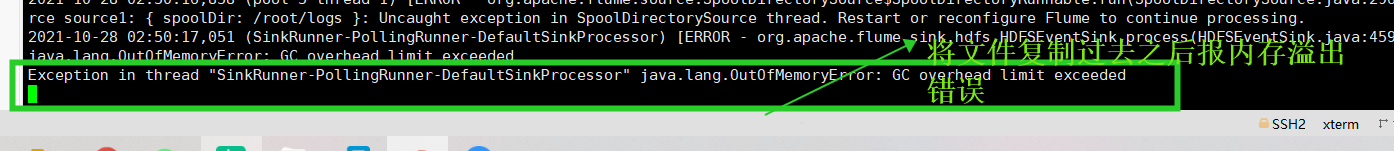

问题描述:

- 在进行文件复制或者移动时出现内存溢出,导致OOM异常时:

原因分析:

- 这个是因为默认的配置的内存大小不足导致的:

解决方案:

- 进入flume下的flume-ng,将下面的内存配置修改即可

- 设置内存

问题三、

问题描述:

- 当使⽤flume-ng进⾏⽇志采集的时候,如果⽇志⽂件很⼤,容易导致flume出现:

java.lang.OutOfMemoryError:Java heap space

解决⽅法:

- 调整flume相应的jvm启动参数。修改 flume下的conf/flume-env.sh⽂件:

export JAVA_OPTS="-Xms100m -Xmx256m -Dcom.sun.management.jmxremote"

版权声明:本文为m0_51322111原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。