完整代码在Github,如有需要可自行下载。

GIthub地址:源码地址

一. 爬取前的准备

糗事百科官网:百度即可

段子网址:百度即可

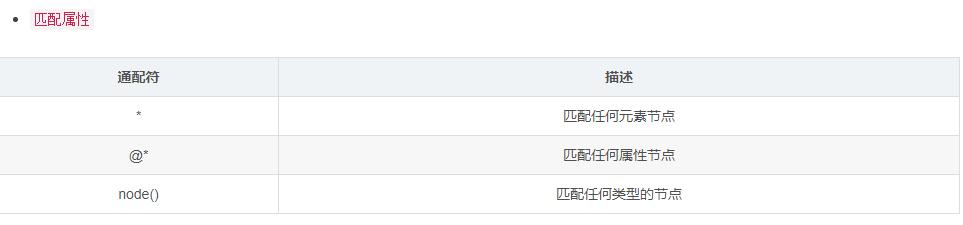

关于解析html博主选择的方法是使用xpath,如有不懂的同学,可看下面两个表格。如果想要深入学习xpath的相关知识可点击博主给的官方

文档的链接进行学习,博主在此声明是为了让读者们能够理解解析式的具体含义。

官网网址:https://lxml.de/tutorial.html

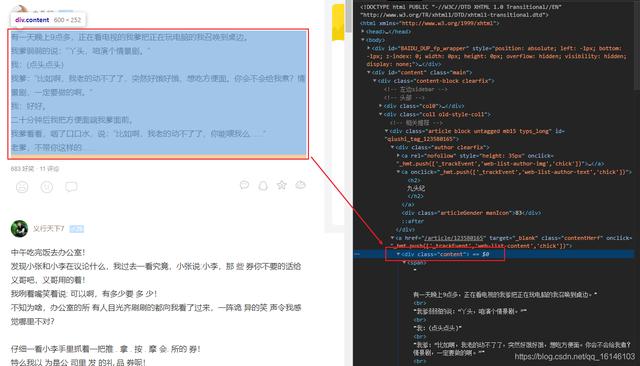

1.1 查看网页

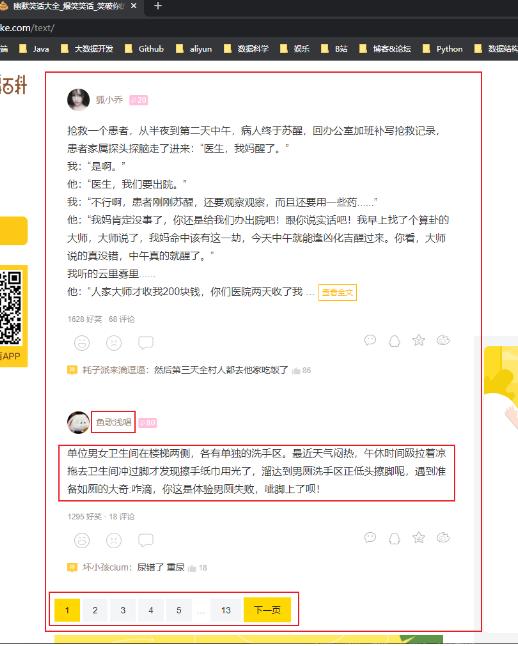

根据上图标记部分可以看到我们主要的要点如下。

- 整体部分

- 作者名称

- 文本内容

- 标签翻页

1.2 标签分析

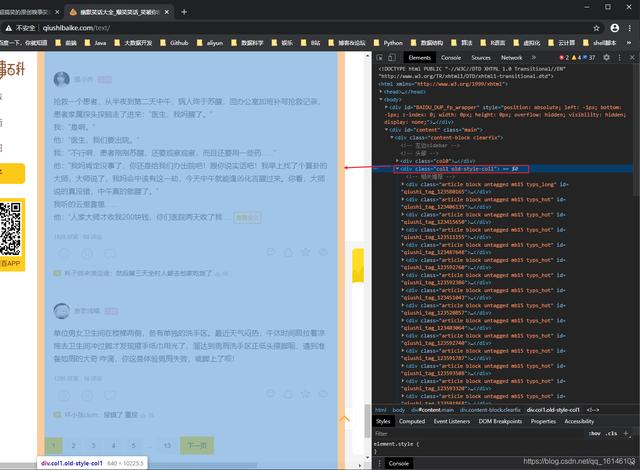

- 1. 首先我们需要知道我们爬取的所有内容所在标签

通过查看开发者选项,发现<div class ="coll old-style-coll">这个标签对应的正是所有内容的整体存放位置,那么我们也可知道之后的所有内容都是从此标签的子标签内提取得到。

分析一番后,我们可以得到获取所有文本内容的解析式如下:

//div[@class = 'col1 old-style-col1']/div 1

- 2. 作者名称所在位置

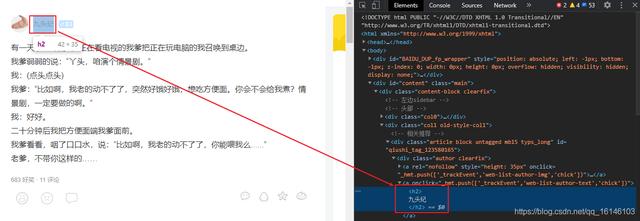

由上图我们可以看到作者的位置在<h2></h2>这个标签中。

分析一番后,我们可以得到获取作者的解析式如下:

.//h2//text() 1

- 3. 作者名称所在位置

由上图我们可以看到段子的位置在<div class ="content"></div>这个标签中。

分析一番后,我们可以得到获取段子的解析式如下:

.//div[@class='content']//text()

- 4. 标签翻页

二. 项目的具体实现

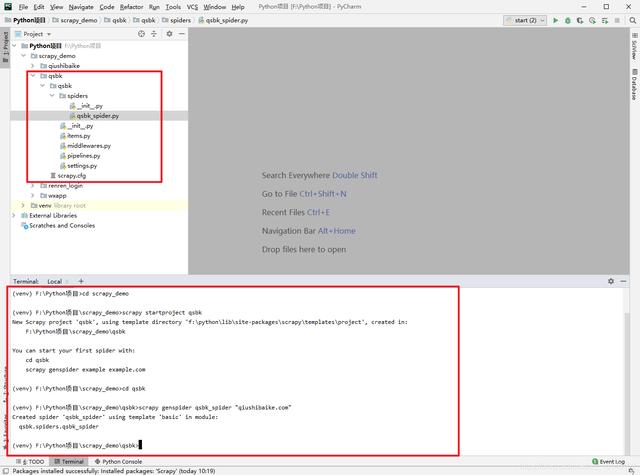

2.1 新建爬虫项目qsbk

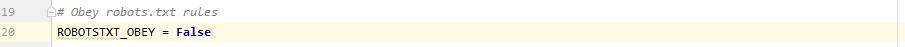

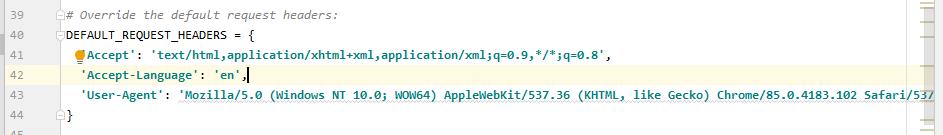

2.2 settings设置

在创建完成一个scrapy项目后,需要对settings进行一些修改

此处默认为True,需要修改为False。否则无法爬取内容。

取消此部分的注解并添加请求头,伪装自己的身份。

2.3 分别提取出作者和文本内容

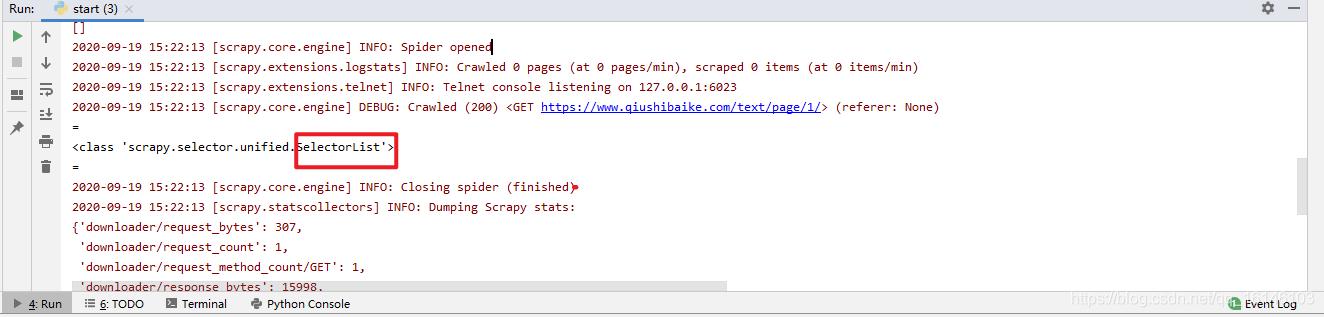

- 1. 查看其类型

duanzidivs = response.xpath("//div[@class = 'col1 old-style-col1']/div")

print("=")

print(type(duanzidivs))

print("=")

1234

通过运行我们可以发现其为SelectorList类型

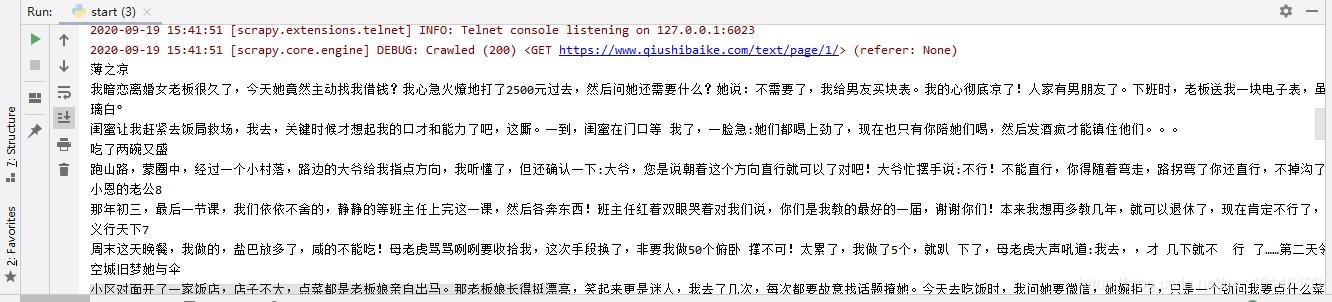

- 2. 通过循环遍历分别打印出作者和文本内容

for duanzidiv in duanzidivs:

# strip() 去除前后的空白字符

author = duanzidiv.xpath(".//h2//text()").get().strip()

content = duanzidiv.xpath(".//div[@class='content']//text()").getall()

content = "".join(content).strip()

print(author)

print(content)

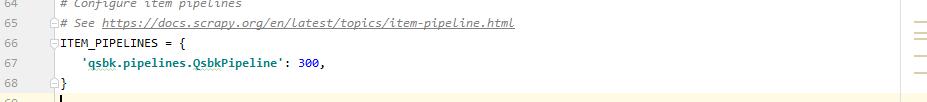

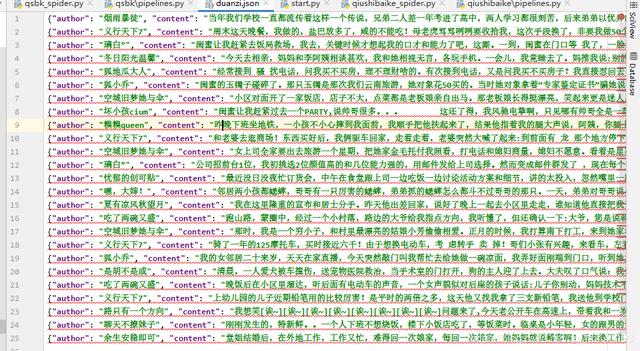

2.4 通过pipeline保存数据

- 前提准备:放开ITEM_PIPELINES的限制

- 1. 第一种方式

class QsbkPipeline:

def __init__(self):

self.fp = open("duanzi.json","w",encoding="utf-8")

def open_spider(self,spider):

print('爬虫开始了 ...')

def process_item(self, item, spider):

item_json = json.dumps(dict(item),ensure_ascii=False)

self.fp.write(item_json+'\n')

return item

def close_spider(self,spider):

self.fp.close()

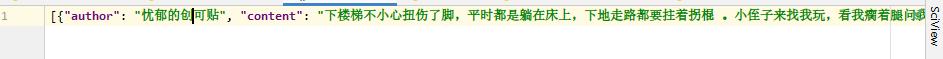

print('爬虫结束了 ...')运行结果:

- 2. 第二种方式:数据量少时使用JsonItemExporter

from scrapy.exporters import JsonItemExporter

class QsbkPipeline:

def __init__(self):

self.fp = open("duanzi.json","wb")

self.exporter = JsonItemExporter(self.fp,ensure_ascii=False,encoding='utf-8')

self.exporter.start_exporting()

def open_spider(self,spider):

print('爬虫开始了 ...')

def process_item(self, item, spider):

self.exporter.export_item(item)

return item

def close_spider(self,spider):

self.exporter.finish_exporting()

self.fp.close()

print('爬虫结束了 ...')运行结果:

- 3. 第三种方式:数据量多使用JsonLinesItemExporter

from scrapy.exporters import JsonLinesItemExporter

class QsbkPipeline:

def __init__(self):

self.fp = open("duanzi.json","wb")

self.exporter = JsonLinesItemExporter(self.fp,ensure_ascii=False,encoding='utf-8')

self.exporter.start_exporting()

def open_spider(self,spider):

print('爬虫开始了 ...')

def process_item(self, item, spider):

self.exporter.export_item(item)

return item

def close_spider(self,spider):

self.fp.close()

print('爬虫结束了 ...')运行结果:

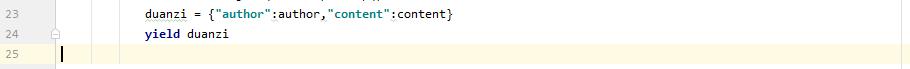

2.5 定义Item

在scrapy中不是说不能直接定义返回字典,但是一般建议现在item中定义好然后进行调用

在item中分别定义author和content

class QsbkItem(scrapy.Item):

author = scrapy.Field()

content = scrapy.Field()

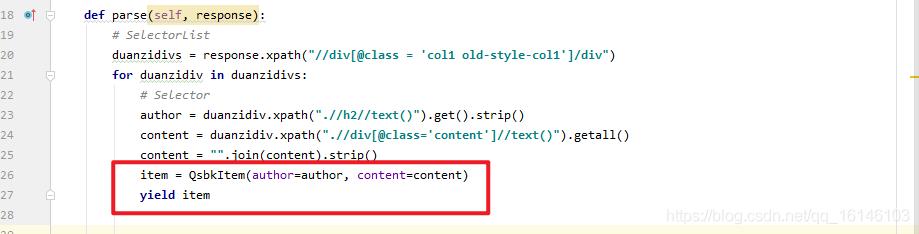

在qsbk_spider中也需要进行如下修改

2.6 爬取多个页面的实现

- 前提准备:放开DOWNLOAD_DELAY的限制并修改为1

# See also autothrottle settings and docs DOWNLOAD_DELAY = 1 12

- 2. 代码实现

# 定义一个基本的域名

base_domain = "https://www.qiushibaike.com"

next_url = response.xpath("//ul[@class='pagination']/li[last()]/a/@href").get()

# 进行一个简单的判断

if not next_url:

return

else:

yield scrapy.Request(self.base_domain+next_url,callback=self.parse)- 3. 运行并查看结果

三. 完整代码(此处只提供修改部分,Github上可查看完整目录及代码)

- 1. qsbk_spider

import scrapy

from scrapy.http.response.html import HtmlResponse

from scrapy.selector.unified import SelectorList

# 继承scrapy.Spider类

from scrapy_demo.qsbk.qsbk.items import QsbkItem

class QsbkSpiderSpider(scrapy.Spider):

name = 'qsbk_spider'

# allowed_domains 指定域名,可以限制爬虫的范围

allowed_domains = ['qiushibaike.com']

# start_urls 开始链接 一般一个即可

start_urls = ['https://www.qiushibaike.com/text/page/1/']

base_domain = "https://www.qiushibaike.com"

def parse(self, response):

# SelectorList

duanzidivs = response.xpath("//div[@class = 'col1 old-style-col1']/div")

for duanzidiv in duanzidivs:

# Selector

author = duanzidiv.xpath(".//h2//text()").get().strip()

content = duanzidiv.xpath(".//div[@class='content']//text()").getall()

content = "".join(content).strip()

item = QsbkItem(author=author, content=content)

yield item

next_url = response.xpath("//ul[@class='pagination']/li[last()]/a/@href").get()

if not next_url:

return

else:

yield scrapy.Request(self.base_domain+next_url,callback=self.parse)

- 2. items

import scrapy

class QsbkItem(scrapy.Item):

author = scrapy.Field()

content = scrapy.Field()- 3. pipelines

from scrapy.exporters import JsonLinesItemExporter

class QsbkPipeline:

def __init__(self):

self.fp = open("duanzi.json","wb")

self.exporter = JsonLinesItemExporter(self.fp,ensure_ascii=False,encoding='utf-8')

self.exporter.start_exporting()

def open_spider(self,spider):

print('爬虫开始了 ...')

def process_item(self, item, spider):

self.exporter.export_item(item)

return item

def close_spider(self,spider):

self.fp.close()

print('爬虫结束了 ...')- 4. settings

BOT_NAME = 'qsbk'

SPIDER_MODULES = ['qsbk.spiders']

NEWSPIDER_MODULE = 'qsbk.spiders'

# Obey robots.txt rules

ROBOTSTXT_OBEY = False

# Configure a delay for requests for the same website (default: 0)

# See https://docs.scrapy.org/en/latest/topics/settings.html#download-delay

# See also autothrottle settings and docs

DOWNLOAD_DELAY = 1

# Override the default request headers:

DEFAULT_REQUEST_HEADERS = {

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

'Accept-Language': 'en',

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/85.0.4183.102 Safari/537.36'

}

# Configure item pipelines

# See https://docs.scrapy.org/en/latest/topics/item-pipeline.html

ITEM_PIPELINES = {

'qsbk.pipelines.QsbkPipeline': 300,

}

美好的日子总是短暂的,虽然还想继续与大家畅谈,但是本篇博文到此已经结束了,如果还嫌不够过瘾,不用担心,我们下篇见!

此文转载文!

原文地址:https://blog.csdn.net/qq_16146103

著作权归作者所有,如有侵权联系小编删除!

写的真好