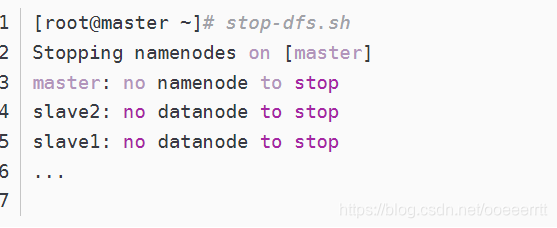

发现问题的起因是,今天规划对hadoop的一些配置参数进行调优。停hadoop集群的时候发现停不下来。输出如下:

1、查找问题

输出显示找不到namenode、datanode等进程,但是jps查看所有进程都正常运行着。原因能存在执行的hadoop/sbin的sh脚本里。百度没有查到合适的解决办法。

于是反查stop-all.sh脚本。发现stop-all.sh 调用的stop-dfs.sh和stop-yarn.sh。两者又调用的hadoop-daemon.sh。

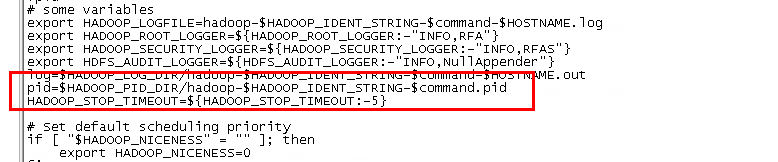

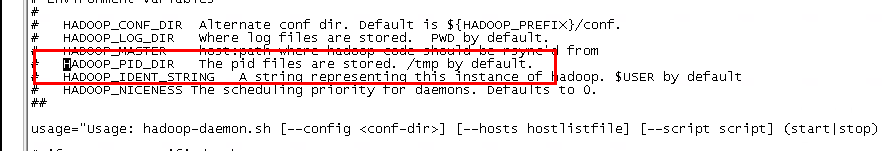

查看hadoop-daemon.sh(以hdfs为例)代码:

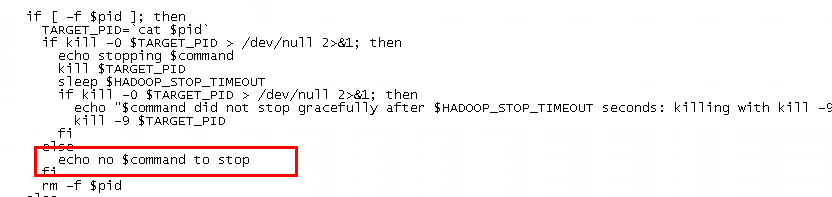

定位到,no namenode to stop 的原因 是 $pid 这个文件不存在。于是向上找 $pid。

$pid是由三个变量拼接而成路径。继续向上找:

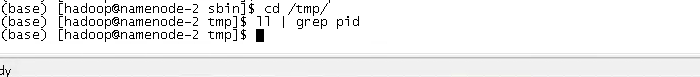

可见$pid路径存储着pid文件,并且如果没有配置的话,默认是/tmp。查可以环境变量中并没有响应的配置。考虑到/tmp目录存在定时清理的情况,大概率是hadoop启动时间长了,pid文件被系统给删除了。

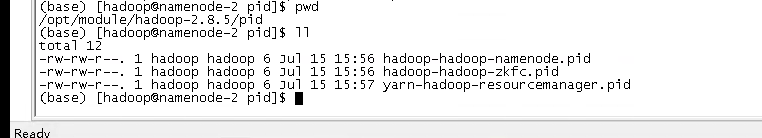

查了一下果然没有。

2、问题处理

既然服务通过命令停对应的进程,去每台服务器kill相应的进程。但是重启的话,pid文件肯定不能再放在/tmp目录了。需要要手动指定一个HADOOP_PID_DIR。

比较简单的一个办法就是去该hadoop-daemon.sh的文件,把默认的/tmp替换成想要的路径。但是本着进来不动源码的原则,最好不要这么做。

另外一个方法就是把HADOOP_PID_DIR设置为环境变量。考虑使用场景较小,没有必要写入系统环境变量。可以写入hadoop的环境变量hadoop-env.sh中,每次启动都会加载hadoop-env.sh。

重启hadoop集群,查看相应的pid路径,pid文件已存在,且不用担心被删除的问题。