语义分割(semantic segmentation)相关知识点

语义分割是目标检测更进阶的任务,目标检测只需要框出每个目标的包围盒,语义分割需要进一步判断图像中哪些像素属于哪个目标。

计算机视觉任务的困难: 拍摄视角变化、目标占据图像的比例变化、光照变化、背景融合、目标形变、遮挡等。

(1) 语义分割常用数据集

PASCAL VOC 2012 1.5k训练图像,1.5k验证图像,20个类别(包含背景)。

MS COCO COCO比VOC更困难。有83k训练图像,41k验证图像,80k测试图像,80个类别。

Cityscapes城市街景图像数据

(2) 语义分割基本思路

基本思路 :逐像素进行图像分类。我们将整张图像输入网络,使输出的空间大小和输入一致,通道数等于类别数,分别代表了各空间位置属于各类别的概率,即可以逐像素地进行分类。

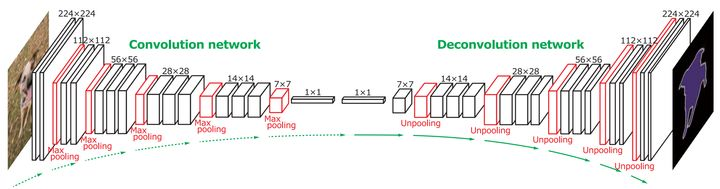

全卷积网络+反卷积网络:为使得输出具有三维结构,全卷积网络中没有全连接层,只有卷积层和池化层。但是随着卷积和池化的进行,图像通道数越来越大,而空间大小越来越小。要想使输出和输入有相同的空间大小,全卷积网络需要使用反卷积和反池化来增大空间大小。

反卷积(deconvolution)/转置卷积(transpose convolution) 标准卷积的滤波器在输入图像中进行滑动,每次和输入图像局部区域点乘得到一个输出,而反卷积的滤波器在输出图像中进行滑动,每个由一个输入神经元乘以滤波器得到一个输出局部区域。反卷积的前向过程和卷积的反向过程完成的是相同的数学运算。和标准卷积的滤波器一样,反卷积的滤波器也是从数据中学到的。

反最大池化(max-unpooling) 通常全卷积网络是对称的结构,在最大池化时需要记下最大值所处局部区域位置,在对应反最大池化时将对应位置输出置为输入,其余位置补零。反最大池化可以弥补最大池化时丢失的空间信息。反最大池化的前向过程和最大池化的反向过程完成的是相同的数学运算。

(3) 语义分割常用技巧

扩张卷积(dilated convolution) 经常用于分割任务以增大有效感受野的一个技巧。标准卷积操作中每个输出神经元对应的输入局部区域是连续的,而扩张卷积对应的输入局部区域在空间位置上不连续。扩张卷积向标准卷积运算中引入了一个新的超参数扩张量(dilation),用于描述输入局部区域在空间位置上的间距。当扩张量为1时,扩张卷积退化为标准卷积。扩张卷积可以在参数量不变的情况下有效提高感受野。例如,当有多层3×3标准卷积堆叠时,第l 层卷积(l 从1开始)的输出神经元的感受野为2l +1。与之相比,当有多层3×3扩张卷积堆叠,其中第l 层卷积的扩张量为2^{l-1}时,第l 层卷积的输出神经元的感受野为2^{l +1}-1。感受野越大,神经元能利用的相关信息越多。和经典计算机视觉手工特征相比,大的感受野是深度学习方法能取得优异性能的重要原因之一。

条件随机场(conditional random field, CRF) 条件随机场是一种概率图模型,常被用于微修全卷积网络的输出结果,使细节信息更好。其动机是距离相近的像素、或像素值相近的像素更可能属于相同的类别。此外,有研究工作用循环神经网络(recurrent neural networks)近似条件随机场。条件随机场的另一弊端是会考虑两两像素之间的关系,这使其运行效率不高。

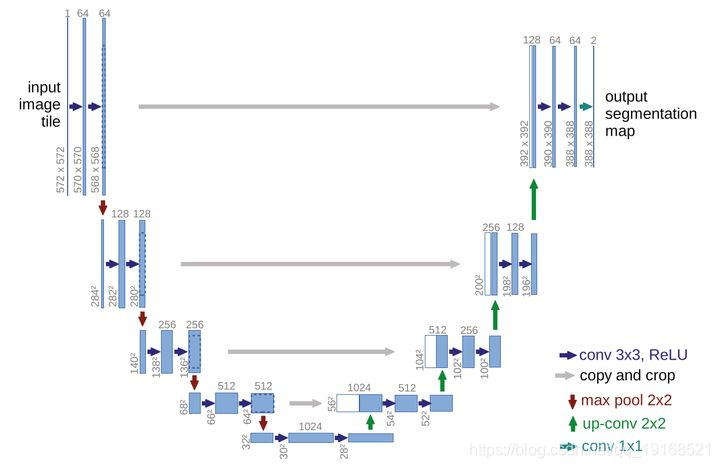

利用低层信息(跳跃结构) 综合利用低层结果可以弥补随着网络加深丢失的细节和边缘信息,利用方式可以是加和(如FCN)或沿通道方向拼接(如U-net),后者效果通常会更好一些。

NAS方法 近年来还有采用NAS+图神经网络的方法进行自动的语义分割网络构建,例如cvpr2020收录的文章Graph-guided Architecture Search for Real-time Semantic Segmentation。NAS 神经架构搜索

,先定义搜索空间,然后通过搜索策略找出候选网络结构,对它们进行评估,根据反馈进行下一轮的搜索。

还有很多方法之后会单独介绍