自监督场景去遮挡

复现源码网站:https://github.com/XiaohangZhan/deocclusion

- 环境

python: 3.7

pytorch>=0.4.1 (实则pytorch: 1.1)

坑一:python3.7安装不上pytorch 0.4(提示:python版本过高)

坑二:用pytorch1.6程序会报错 (后来得知作者用的是pytorch1.1,解决了报错问题)

- 利用Anaconda中创建虚拟环境

- 将conda切换至清华源

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main/

conda config --set show_channel_urls yes

- 添加Pytorch 清华源(清华源针对pytorch有单独的源)

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/pytorch/

- 创建新的虚拟环境

conda create -n新环境名python=版本号(新环境名自己随便取)

这里我用的:conda create -n py3.7 python=3.7

- 激活/切换至新的虚拟环境

conda activate环境名

这里我的是:conda activate py3.7

- 安装Pytorch

首先到pytorch官网(https://pytorch.org/)根据自己的情况选择相应版本的安装指令

# V1.1.0 CUDA 10.0

conda install pytorch==1.1.0 torchvision==0.3.0 cudatoolkit=10.0 -c pytorch

末尾的 -c pytorch 要去掉,否则下载的源会默认是pytorch官方源,速度贼慢

- 验证

输入python查看并进入python环境

在python交互页面输入

>>> import torch

>>> print(torch.__version__)

查看pytorch版本,若报错则说明安装失败

![]()

- 所需要的数据集与预训练模型

- COCO2014 train and val images

- COCOA annotations

- KITTI dataset

- KINS annotations

- Model of the GCA Matting——gca-dist-all-data

- pre-trained image inpainting model using partial convolution(PCNet-C用到)

部分不好下载的已上传到G-Meteor/self-supervised-de-occlusion (github.com)

- 根据自述文件里的操作训练并评估PCNet-M与PCNet-C网络

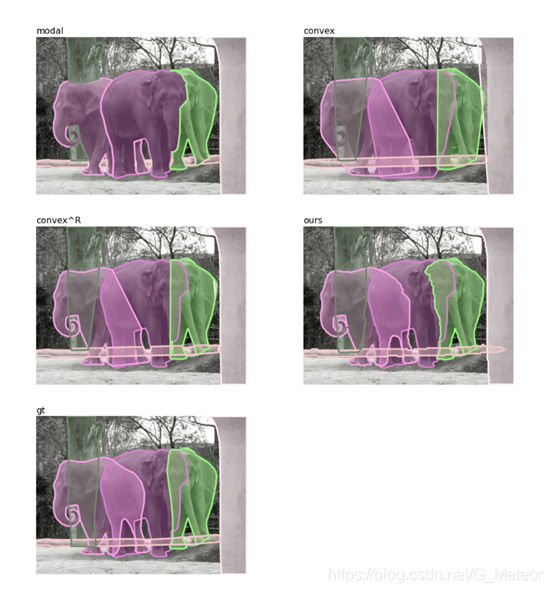

- 评估结果(PCNet-M)

acc_allpair (accuracy for all pairs): 0.96014(遮挡顺序)

acc_occpair (accuracy for occluded pairs): 0.87112 (遮挡顺序)

mIoU (amodal修复): 0.81346

pAcc (pixel accuracy): 0.87744

- 可视化效果

Amodal Completion可视化(PCNet-M) |

原图 |

分割出的背景图 |

Content Completion可视化(PCNet-C) |