文章目录

一、感知机

1、特点

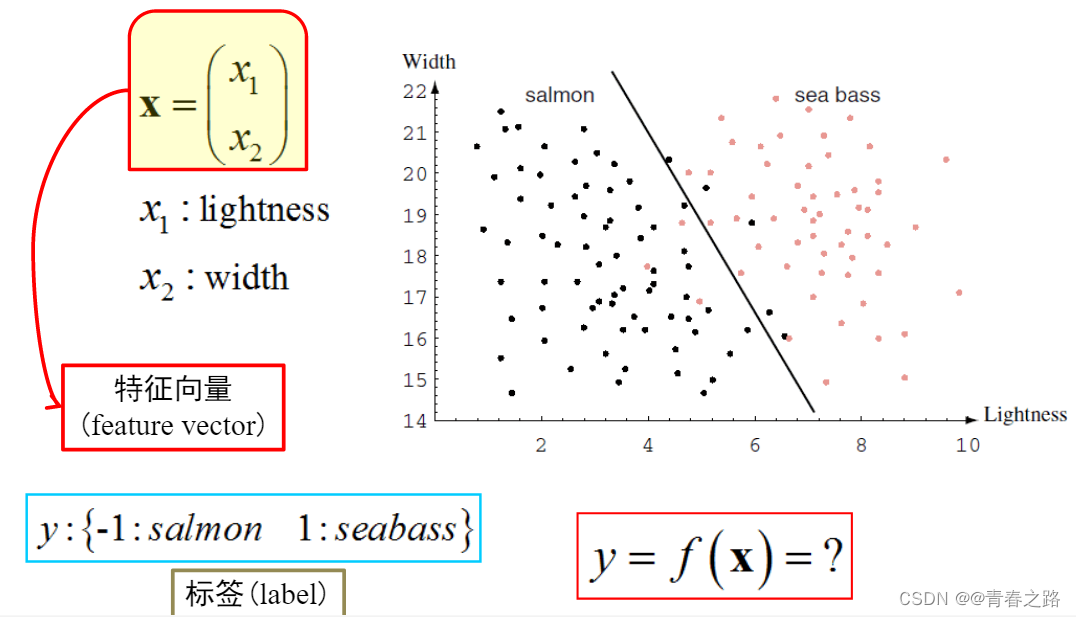

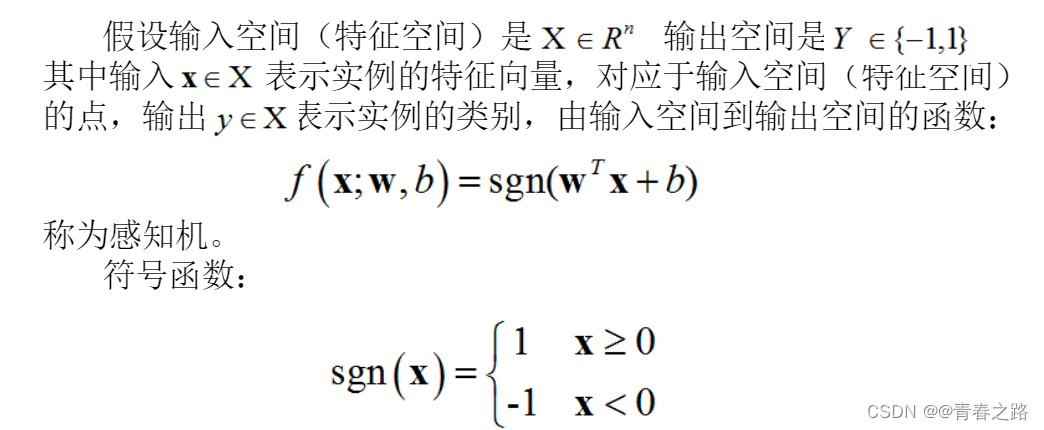

- 输入为实例的特征向量,输出为实例的类别,取+1和-1

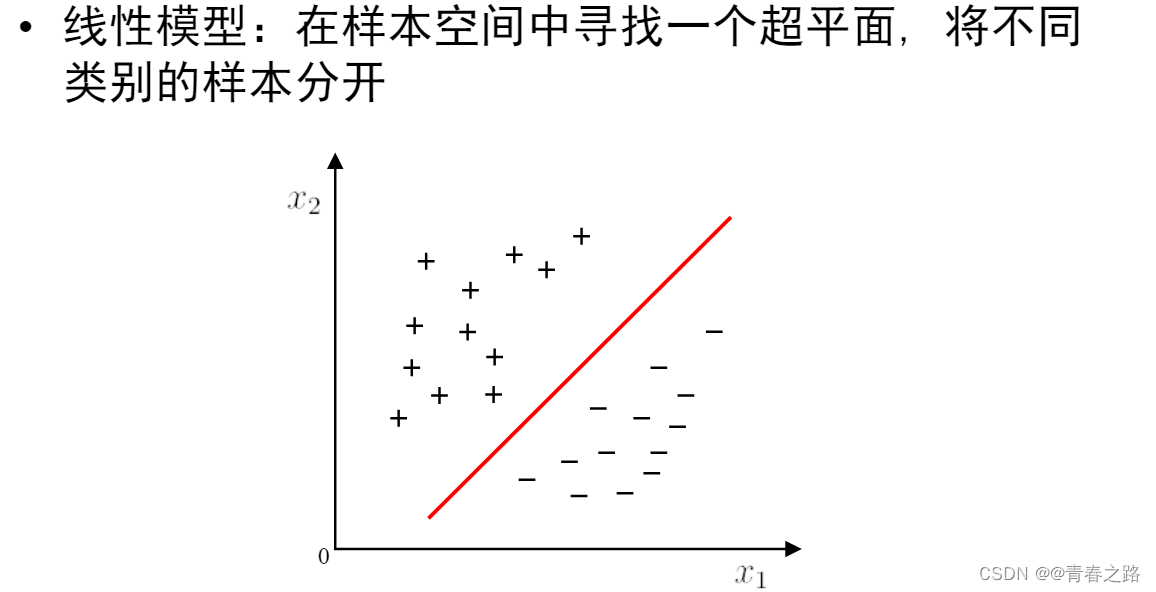

- 感知机对应于输入空间中将实例划分为正负两类的分离超平面

- 导入基于误分类的损失函数

- 利用梯度下降法对损失函数进行极小化

- 感知机学习算法具有简单而易于实现的优点

- 1957年由Rosenblatt提出,是神经网络与支持向量机的基础

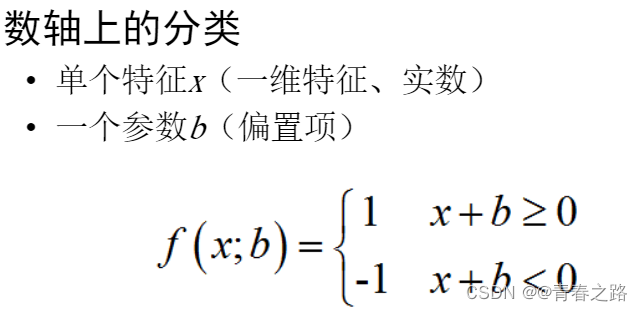

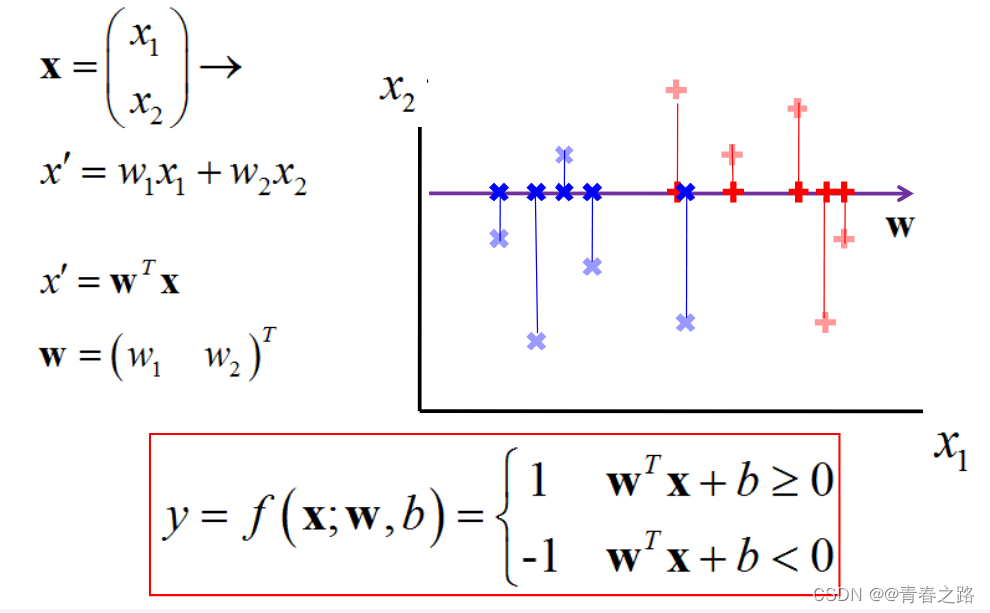

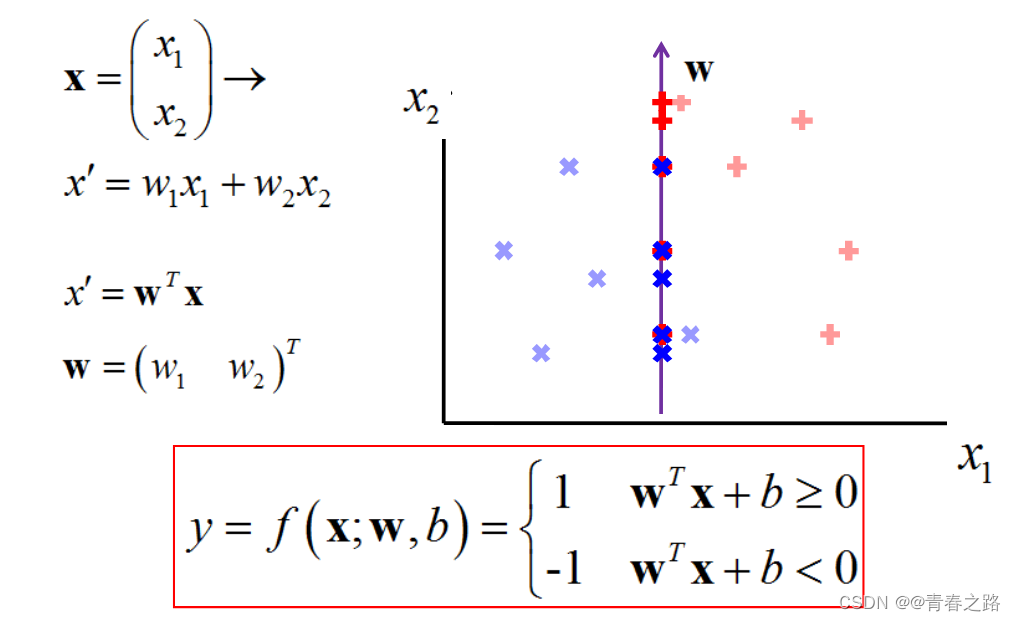

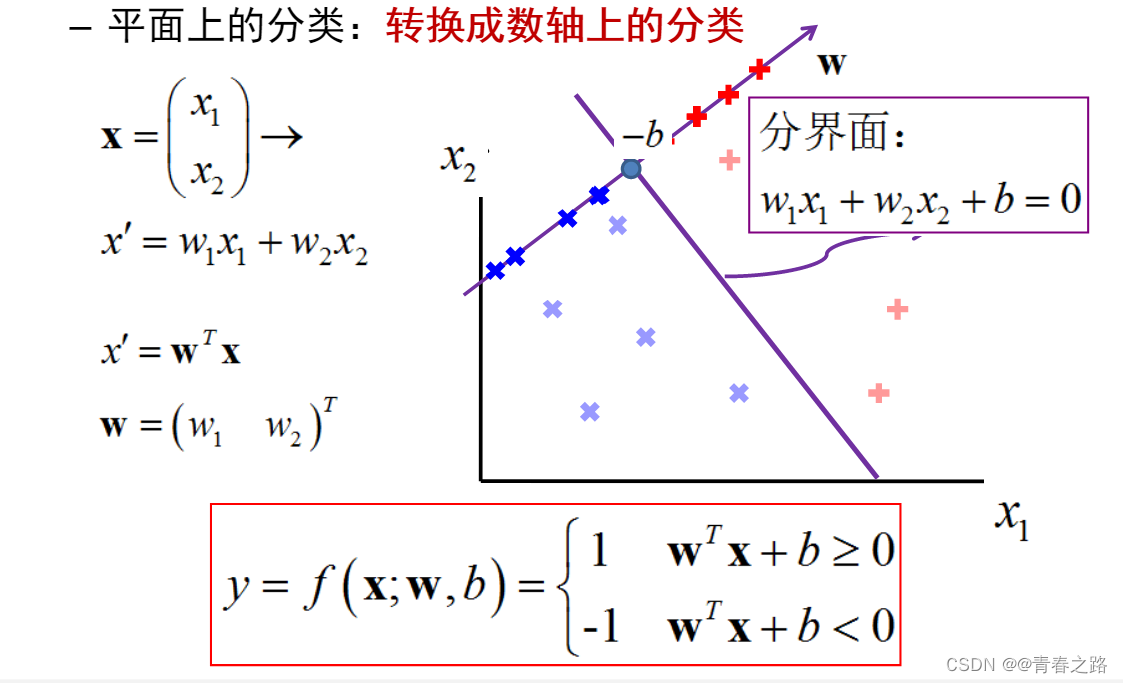

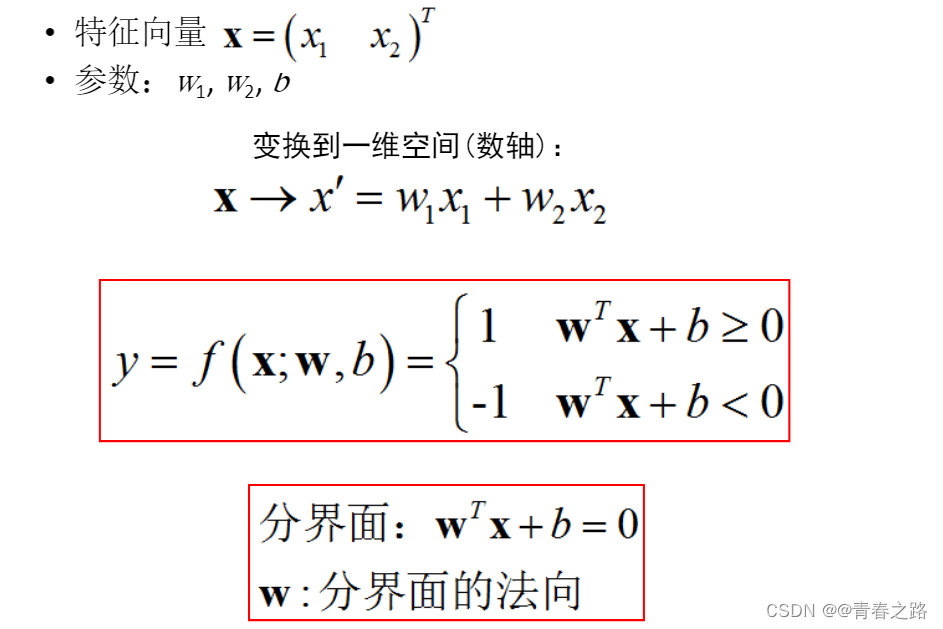

2、感知机模型

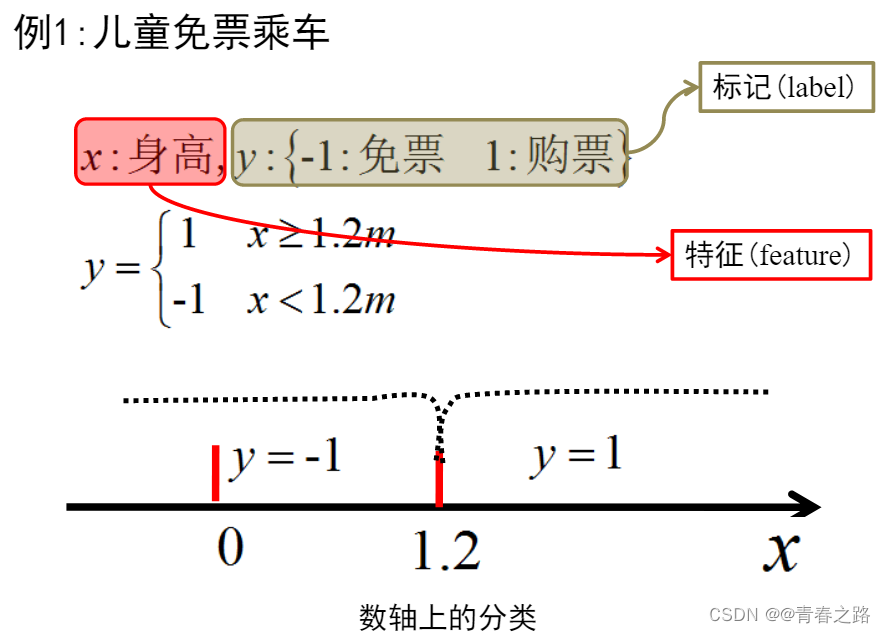

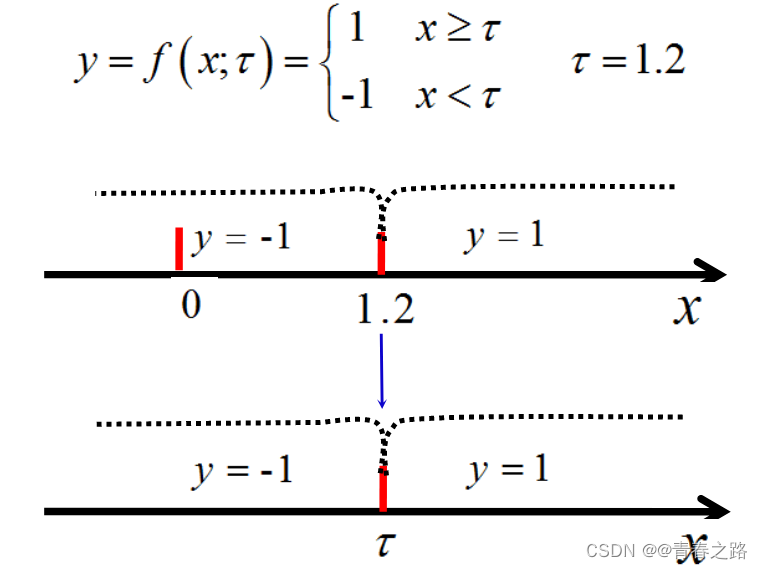

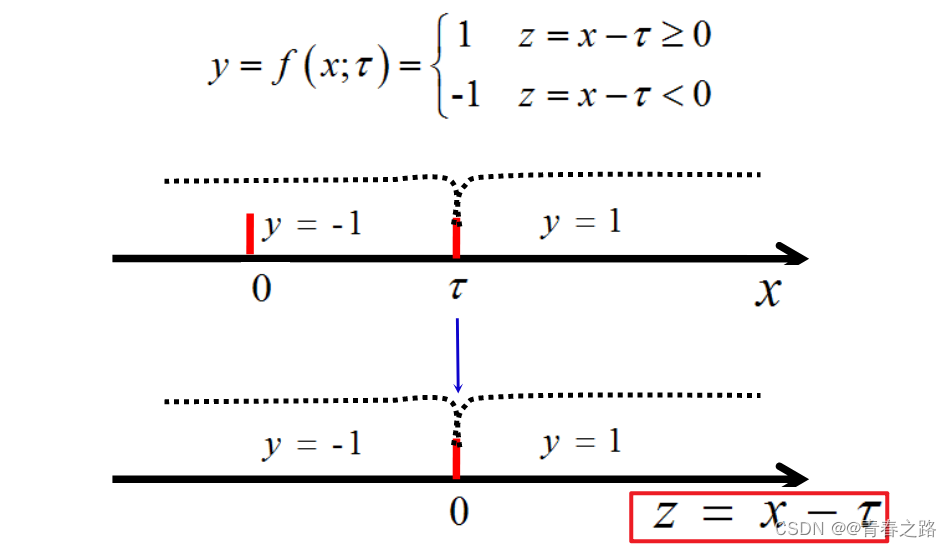

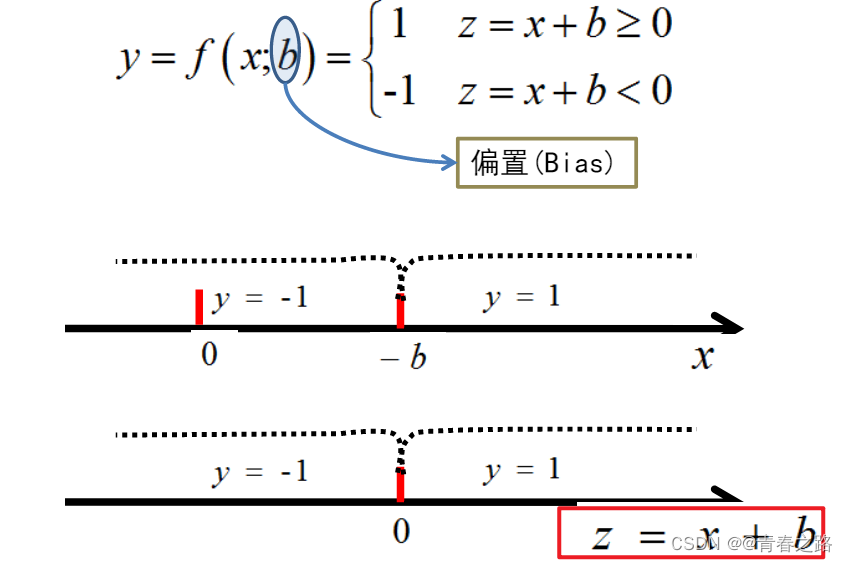

2.1、例1:儿童免乘车票

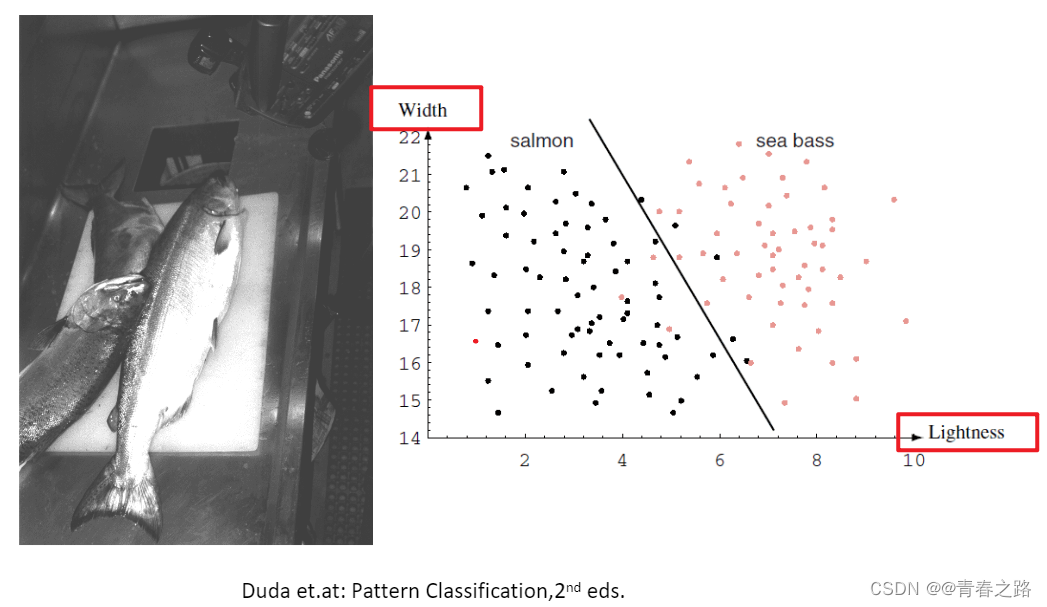

2.2、例2:鱼的分类

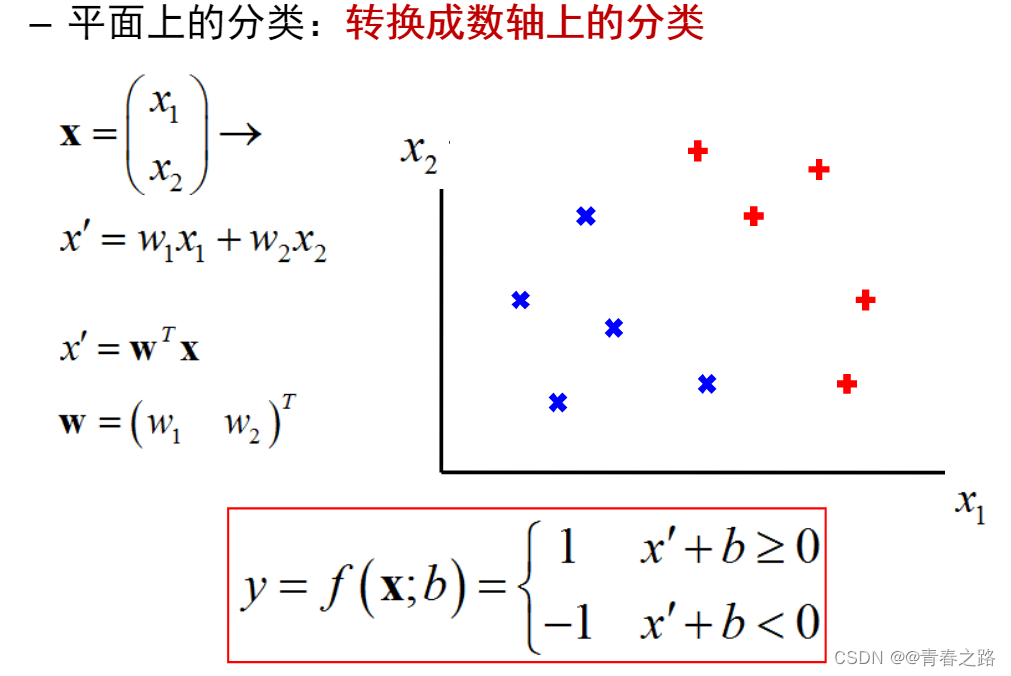

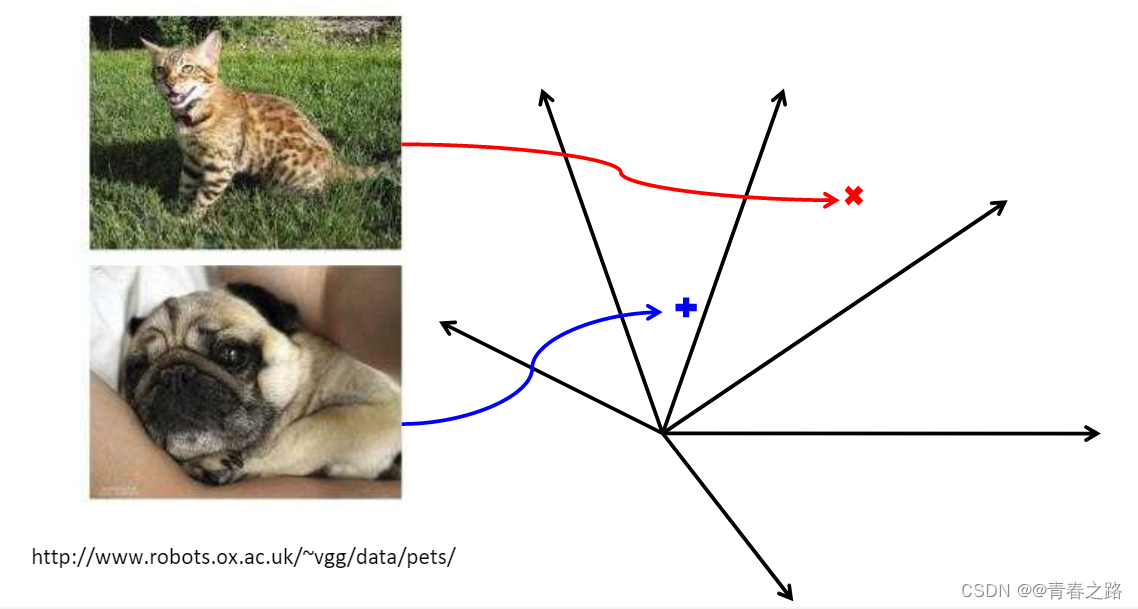

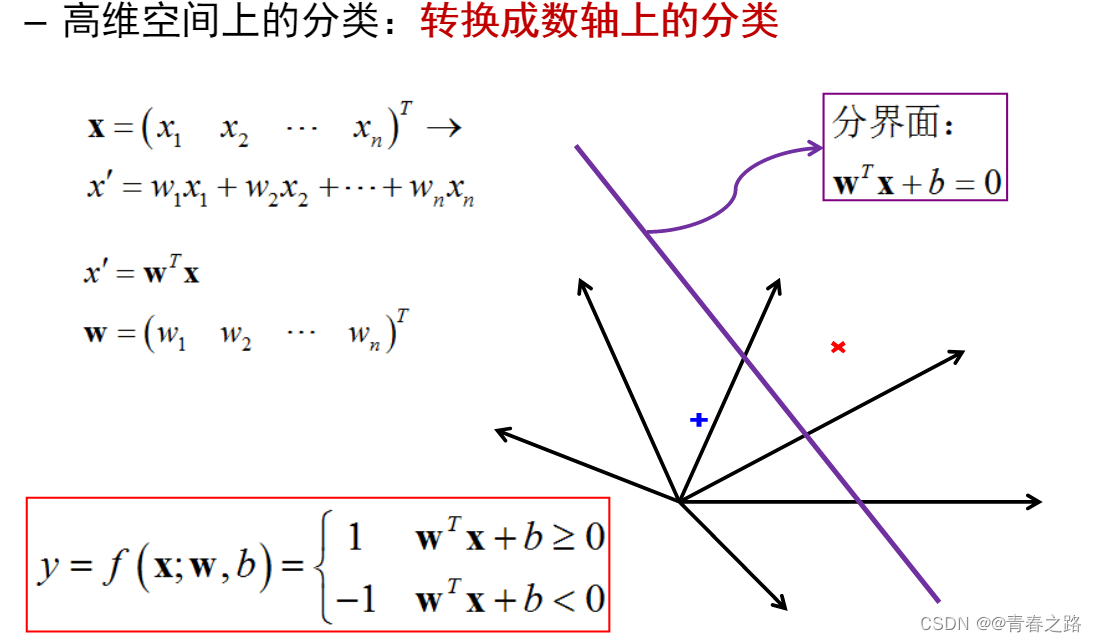

2.3、例3:高维空间上的分类

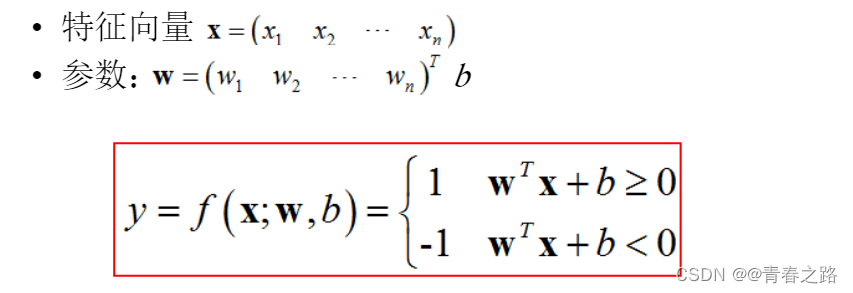

2.4、感知机的定义

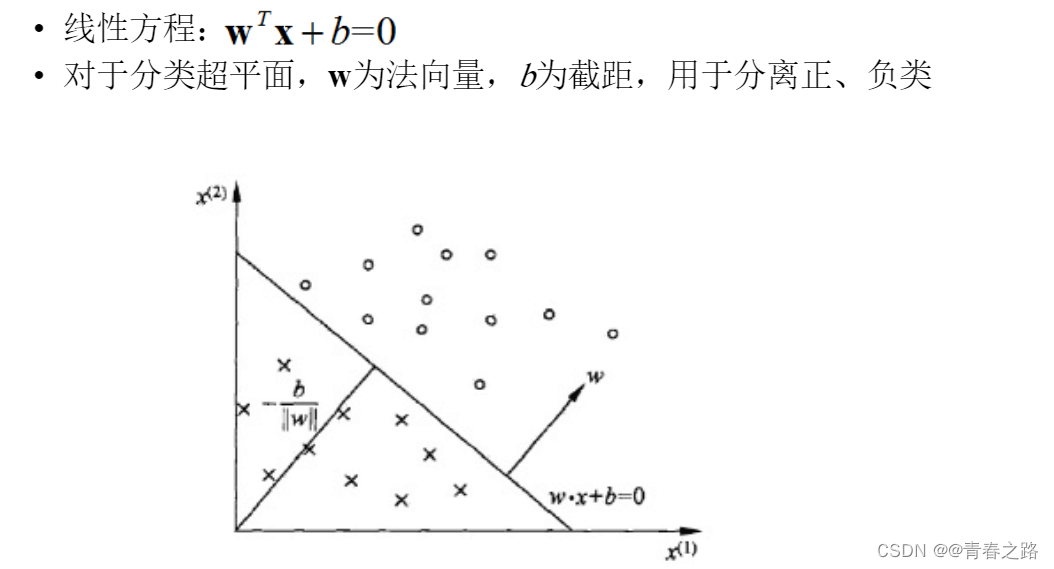

2.5、感知机的几何解释

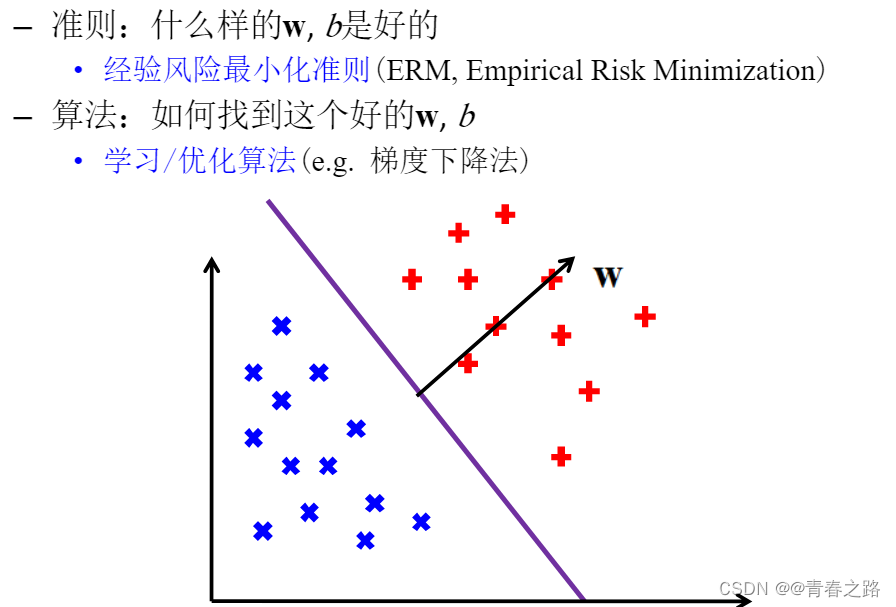

3、学习策略

3.1、两个问题

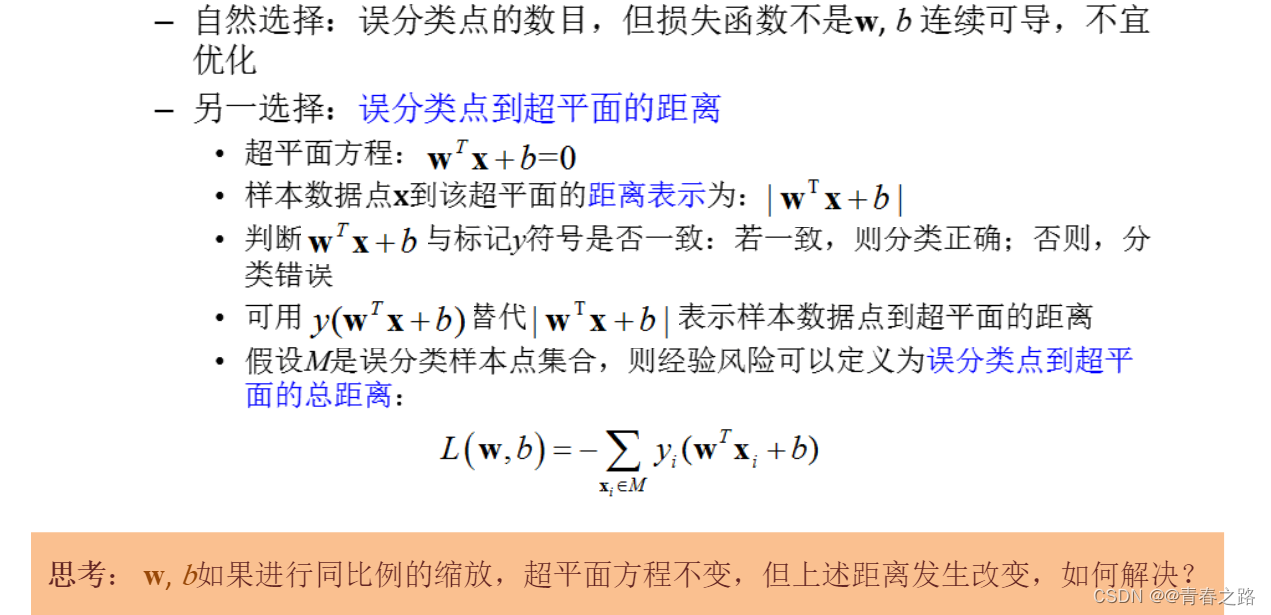

3.2、损失函数

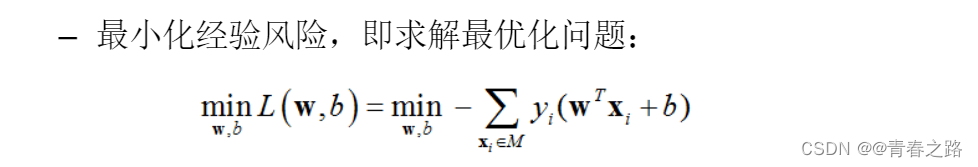

3.3、优化目标

4、学习算法

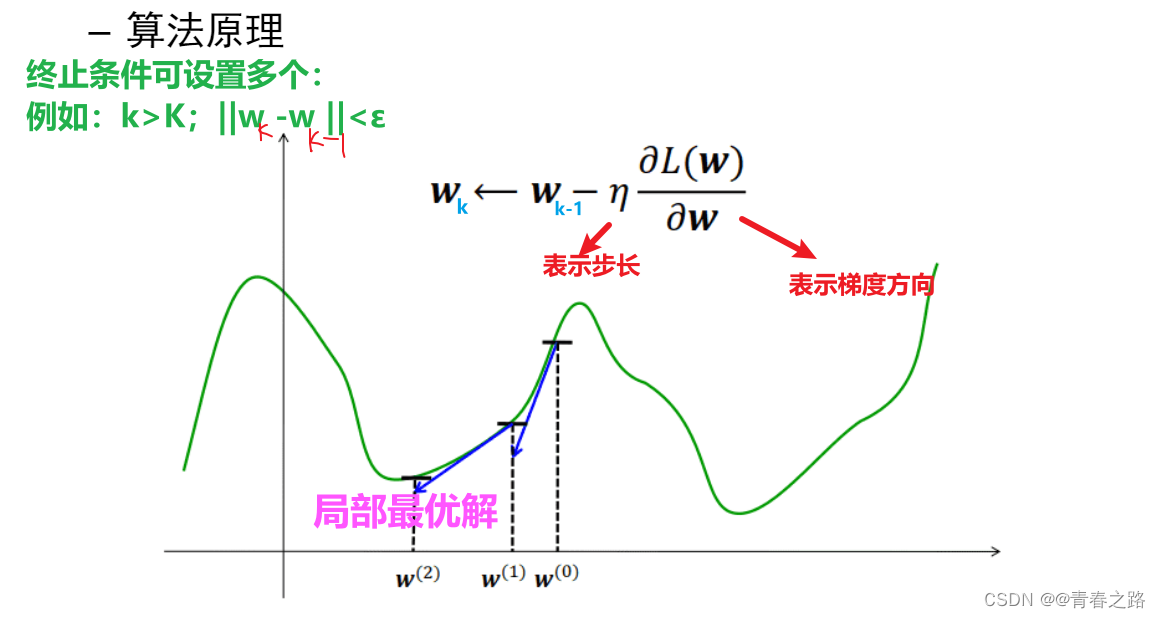

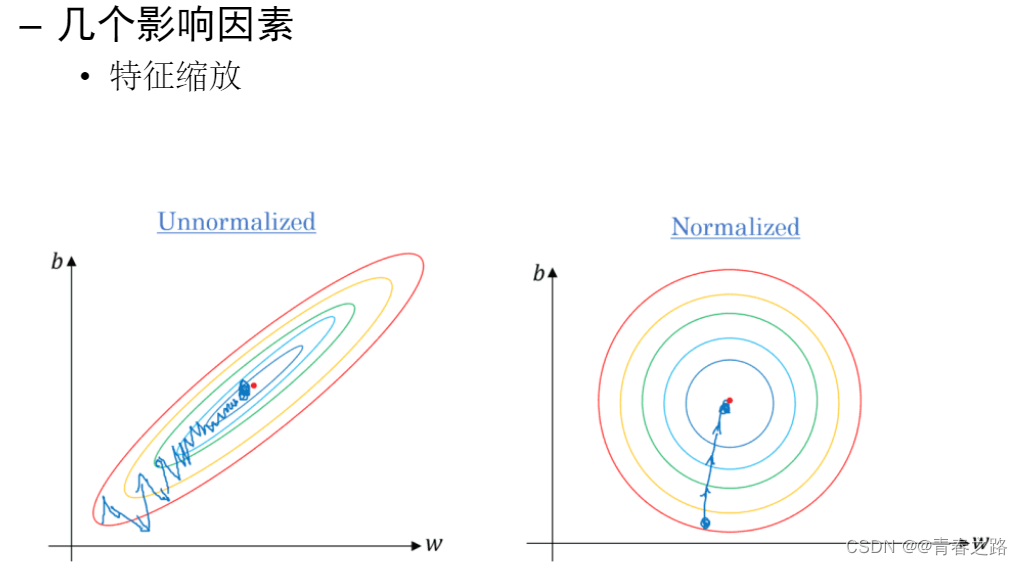

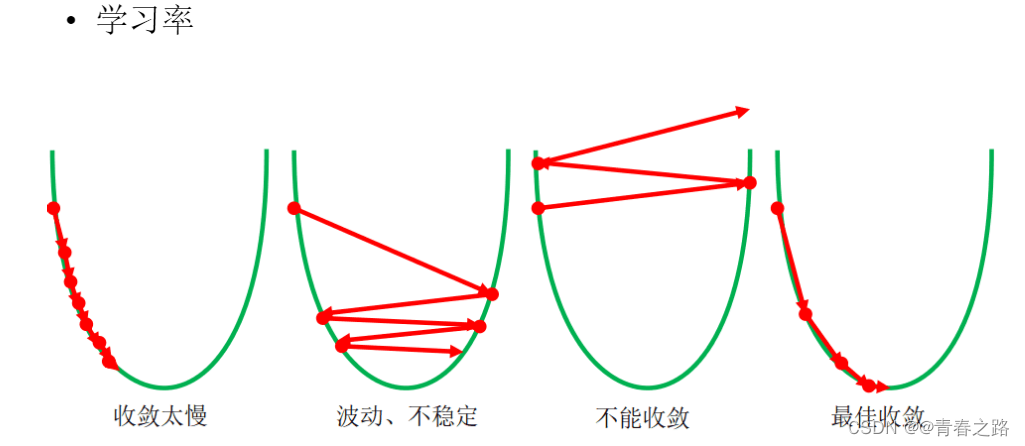

4.1、梯度下降法

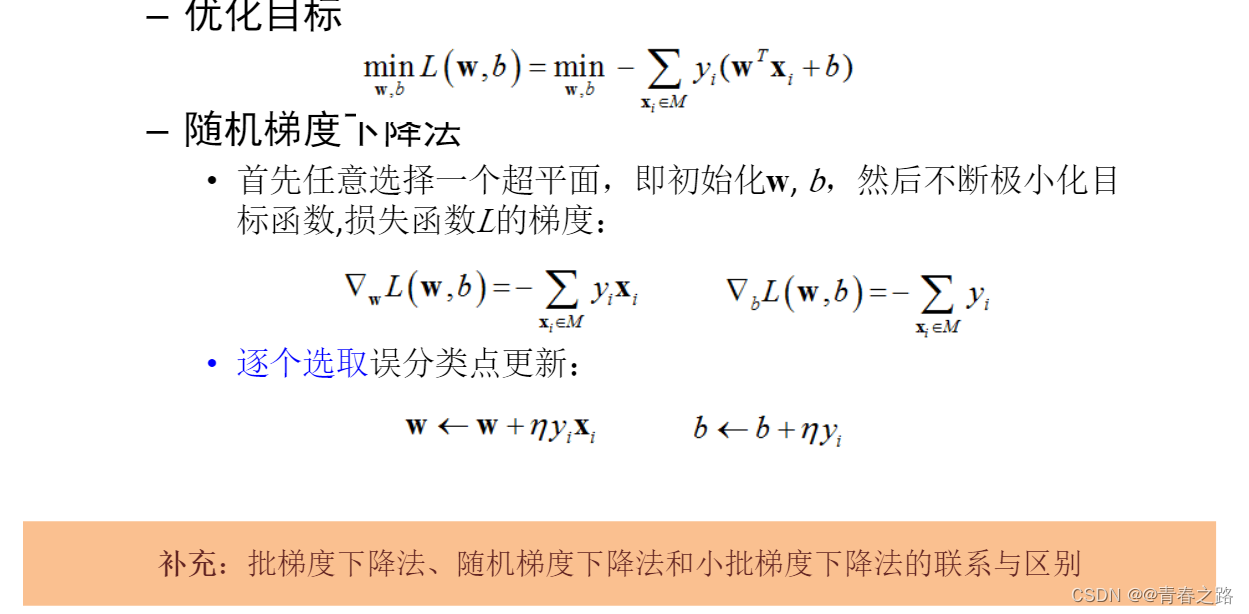

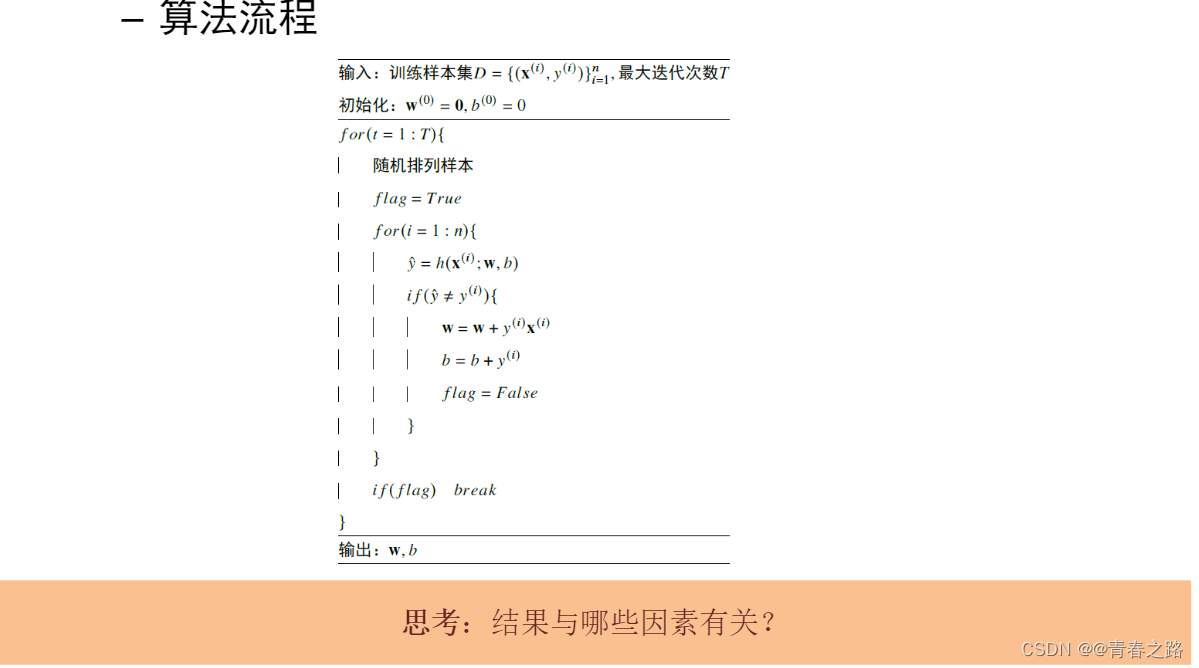

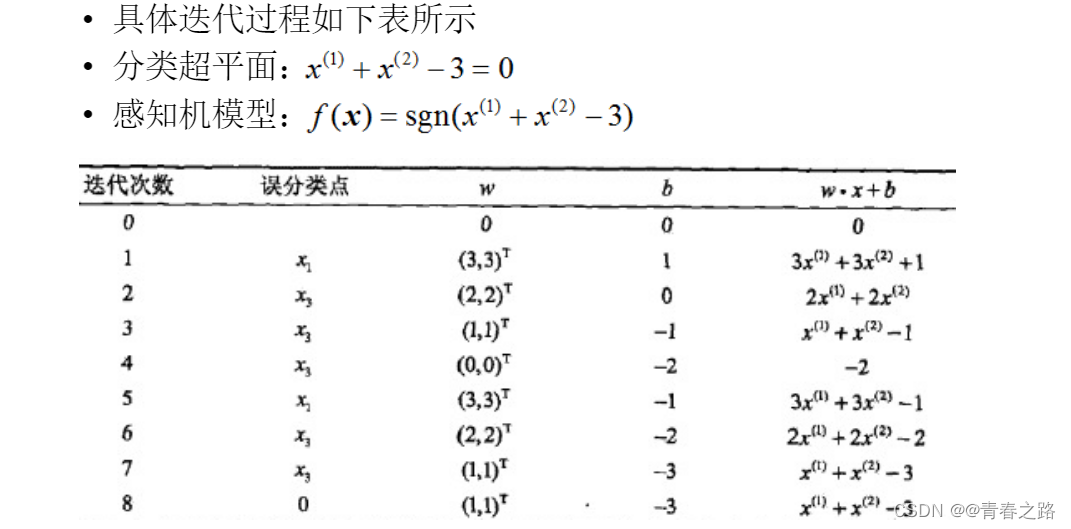

4.2、感知机学习算法

batch:拿总体样本,一次性更新。 优点:稳定 缺点:复杂,耗时

随机梯度下降法:逐个拿样本进行更新。 优点:简单,耗费低 缺点:不稳定

mini-batch:选择部分样本进行更新,综合考虑了batch和随机梯度下降的优点。

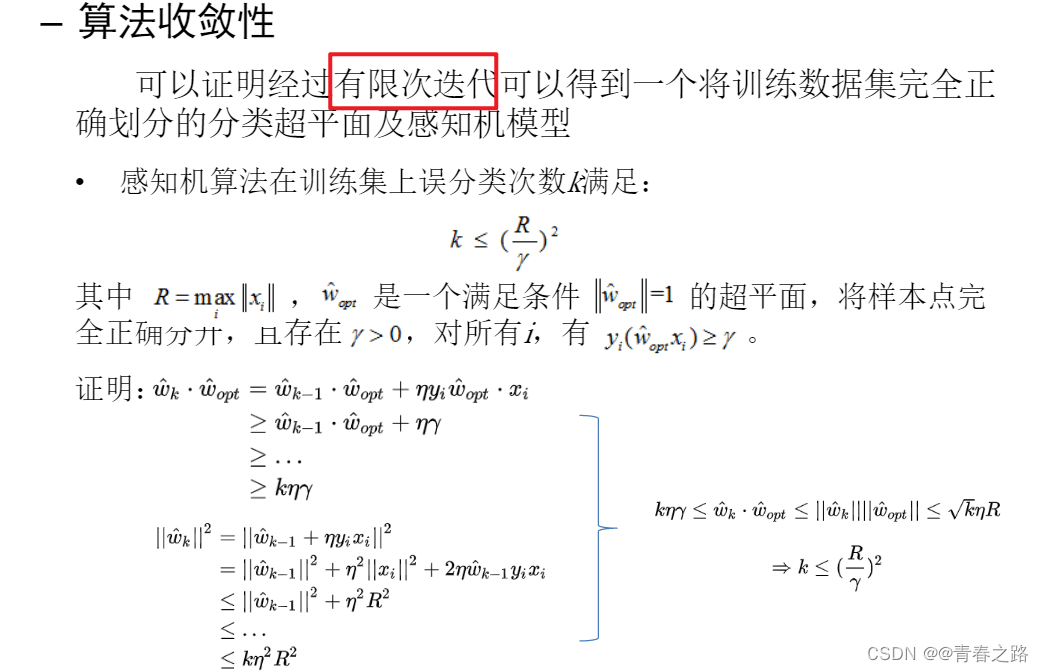

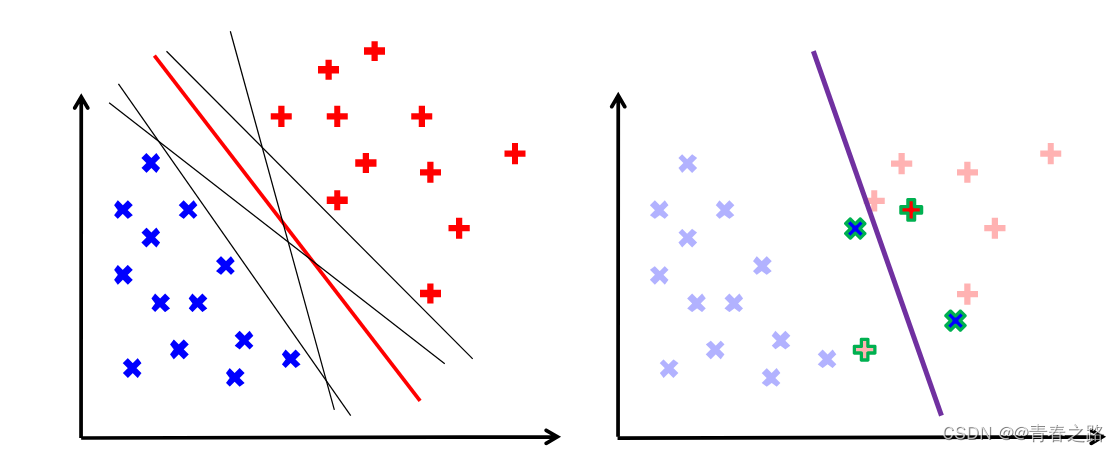

5、存在的问题

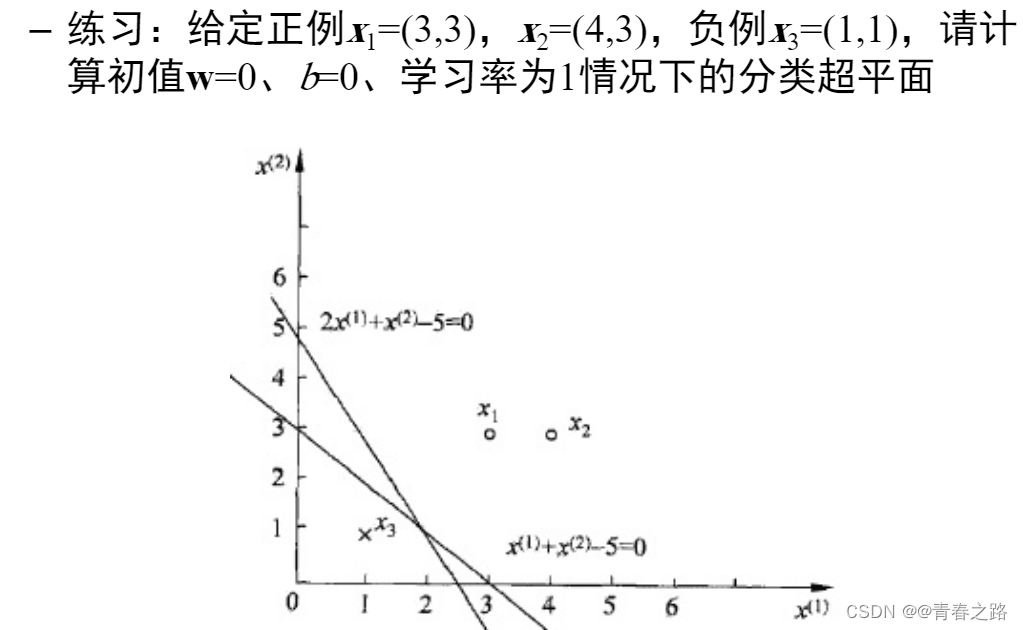

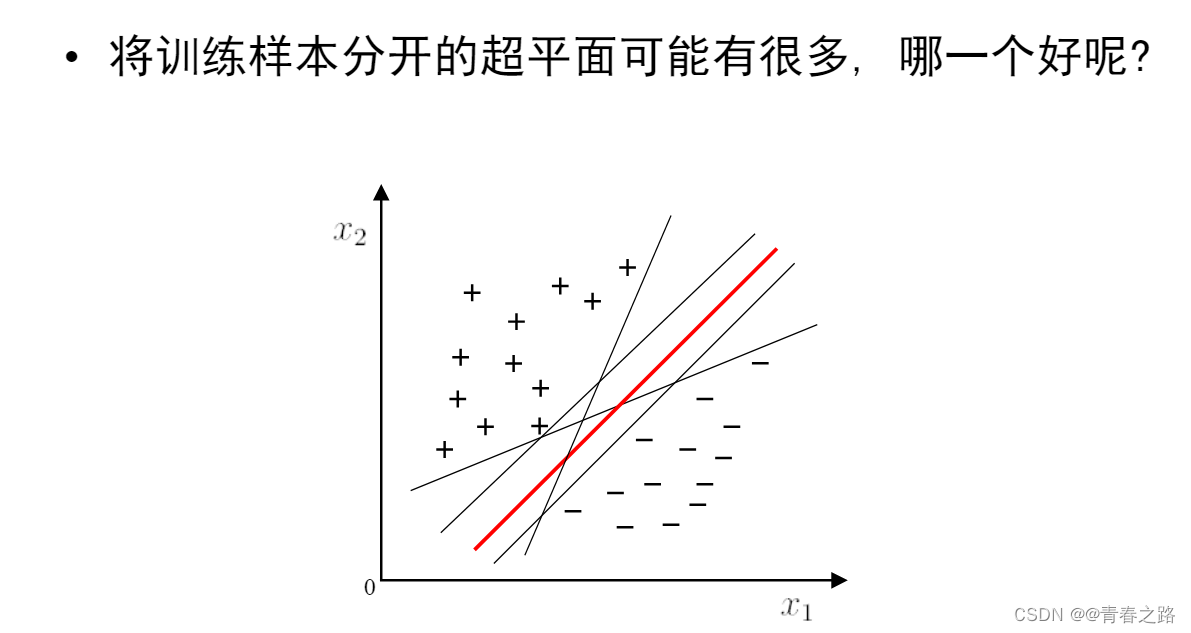

- 感知机算法存在许多解【不唯一】,既依赖于初值,也依赖迭代过程中误分类点的选择顺序

- 线性不可分数据集,迭代震荡

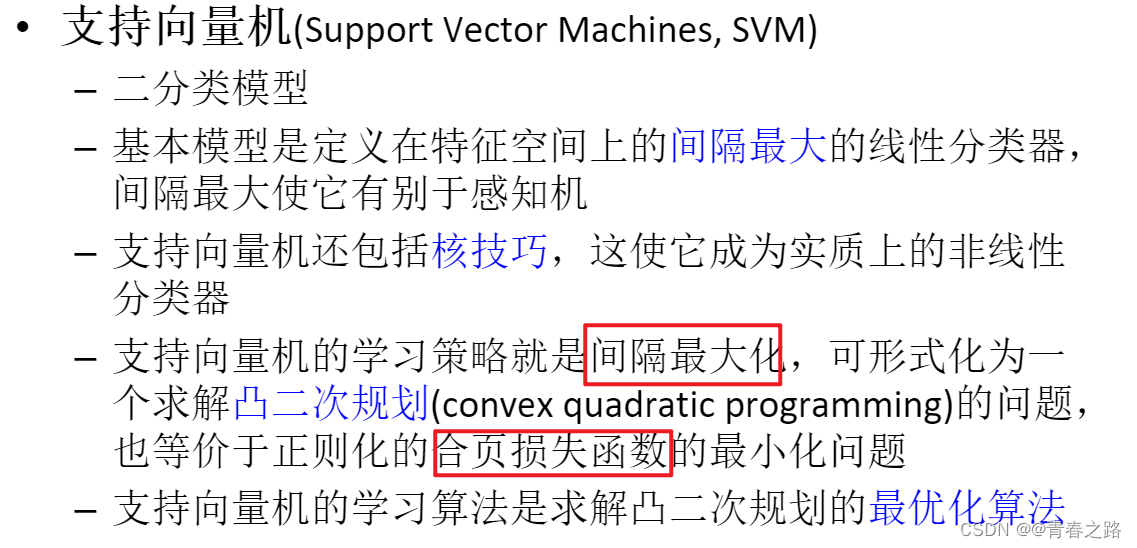

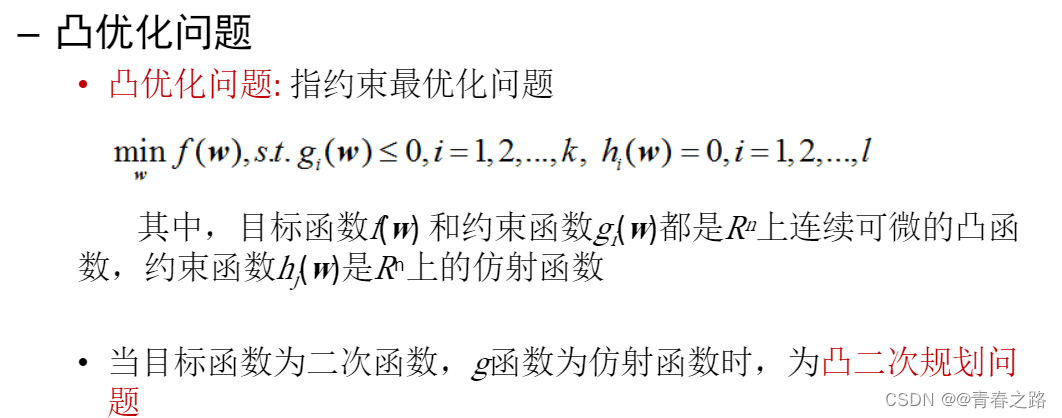

二、支持向量机

1、概述

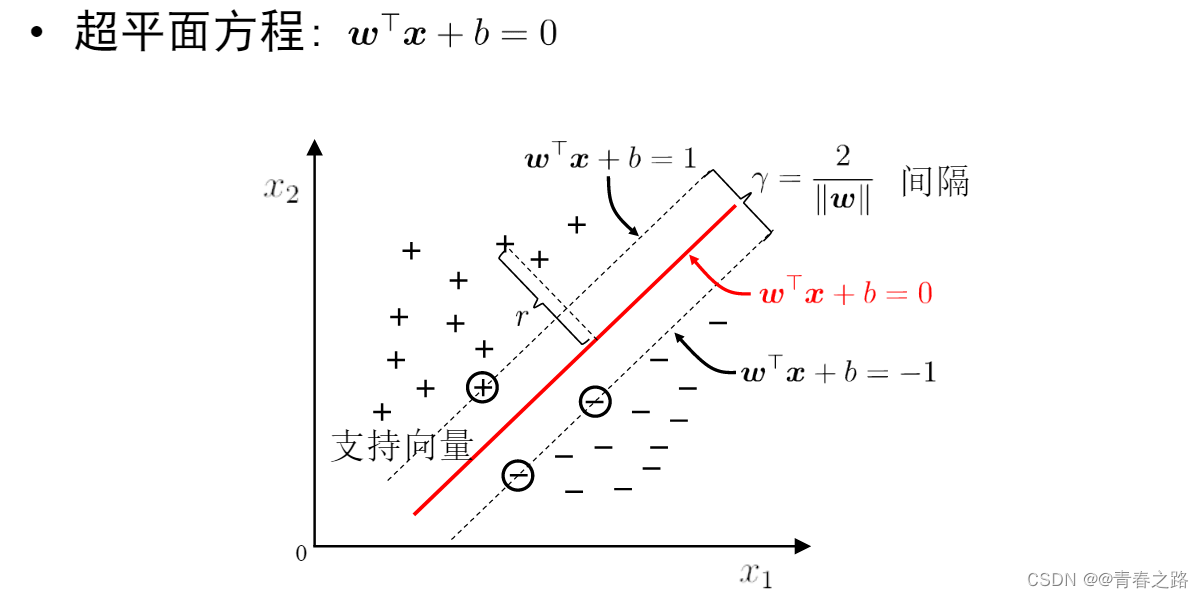

- 感知机的分类超平面不唯一问题–增加约束,如SVM中的最大化间隔

- 感知机无法解决非线性问题–使用核方法,映射到高维空间

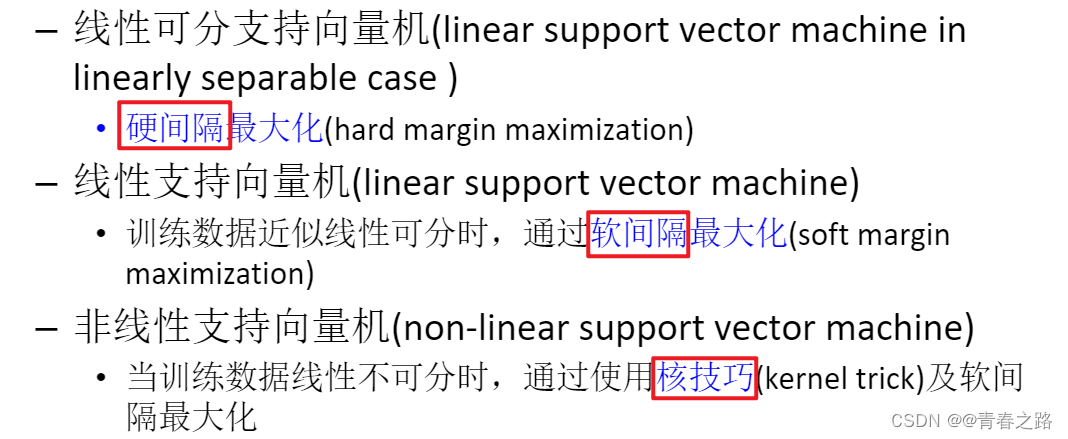

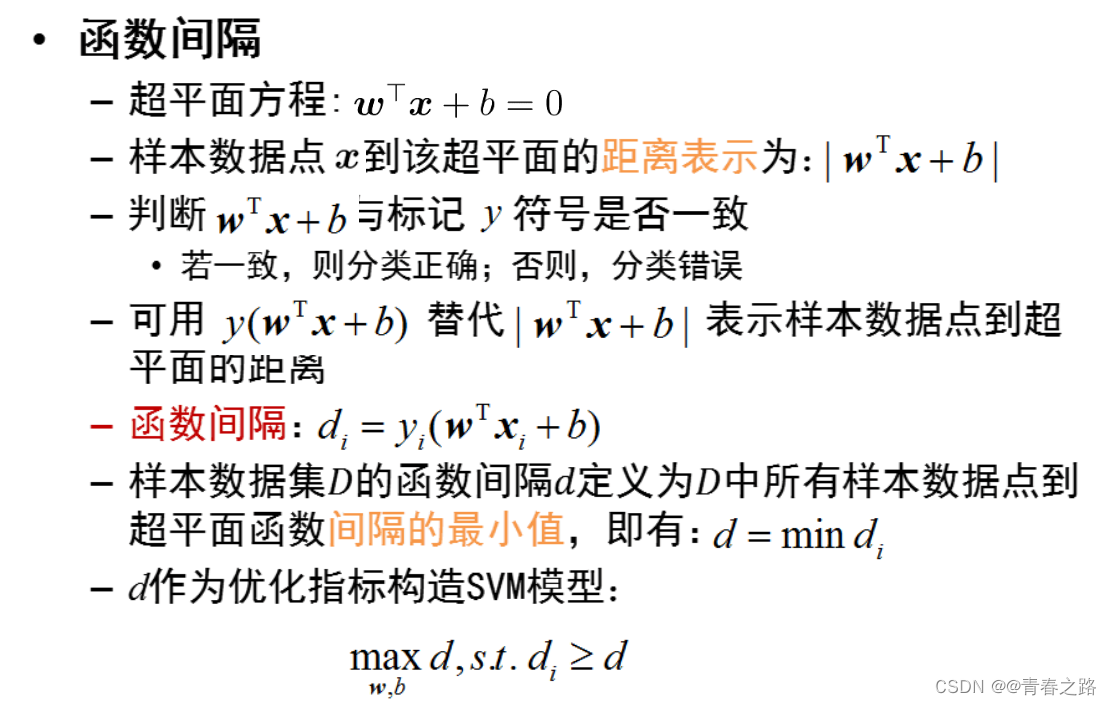

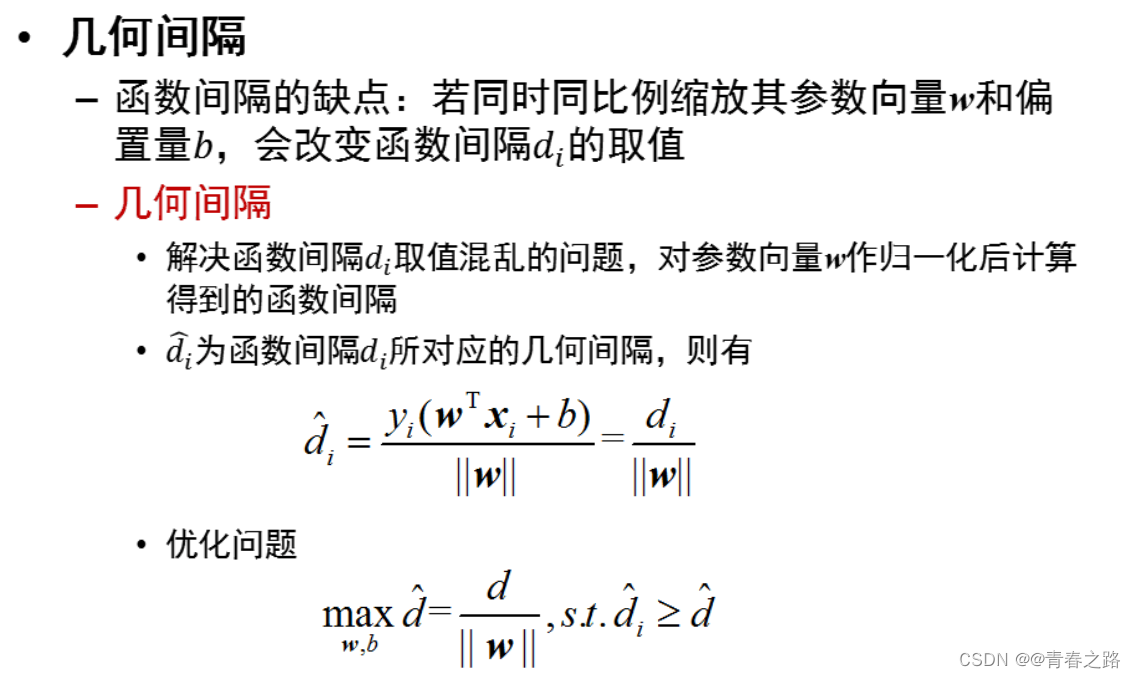

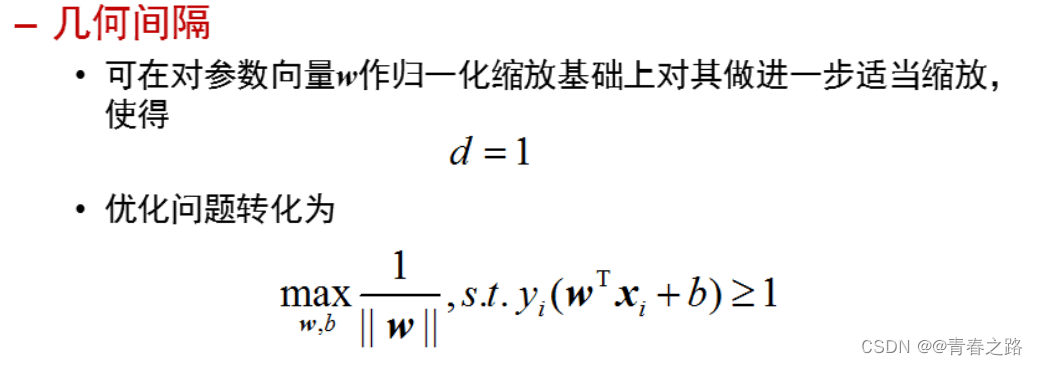

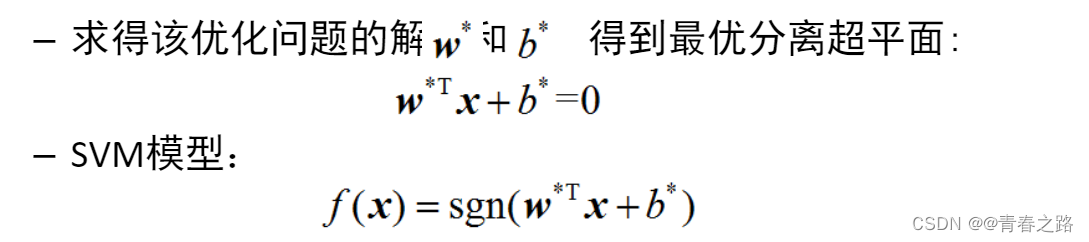

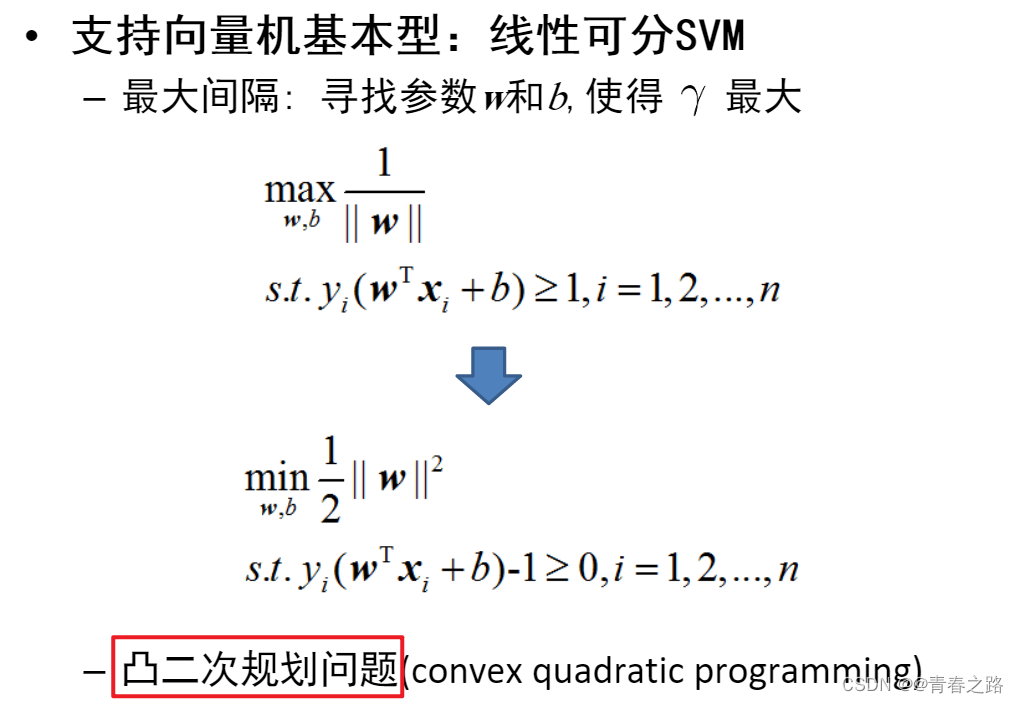

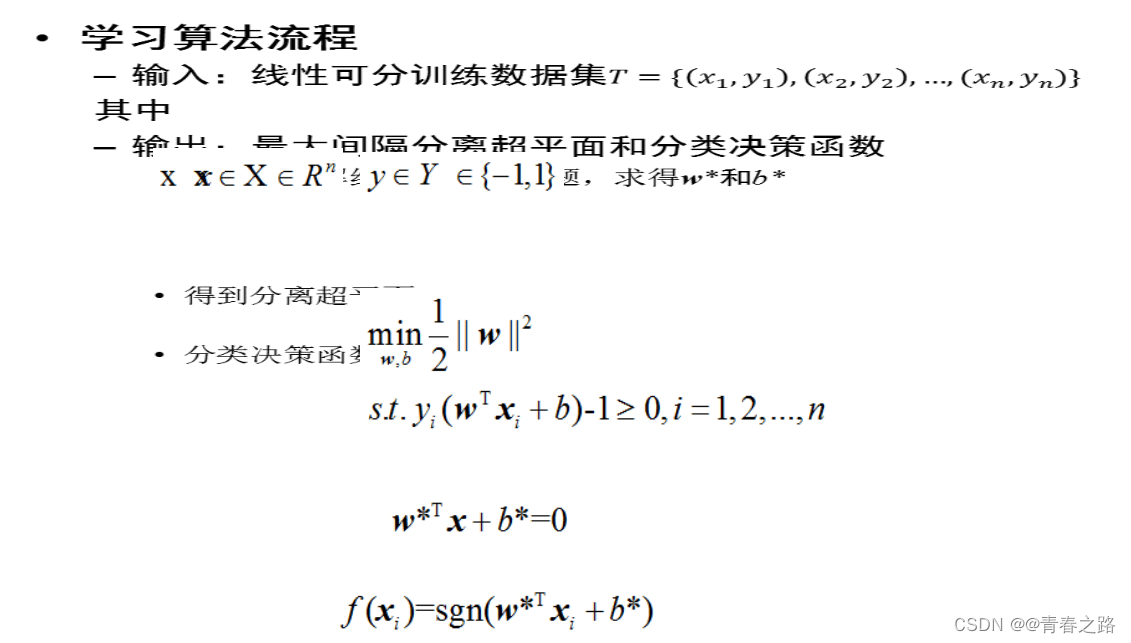

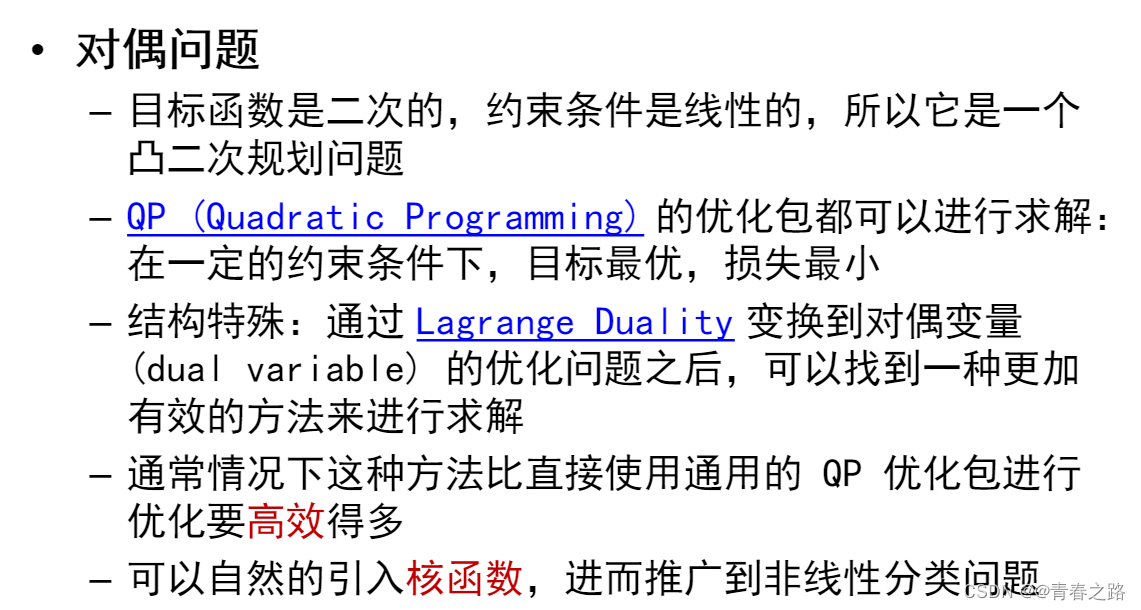

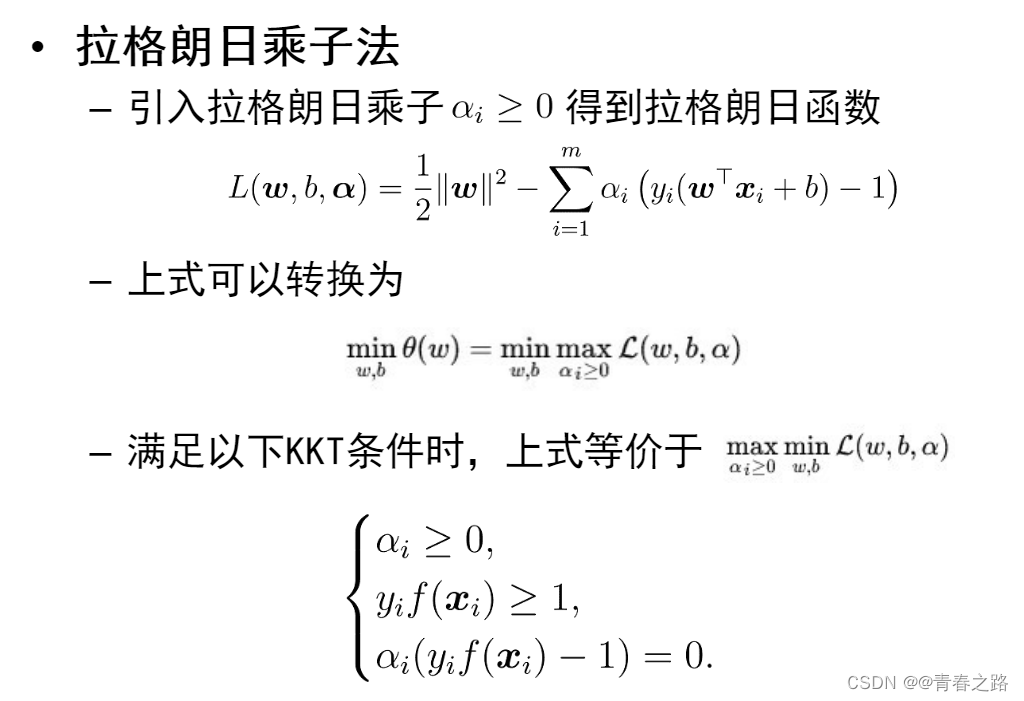

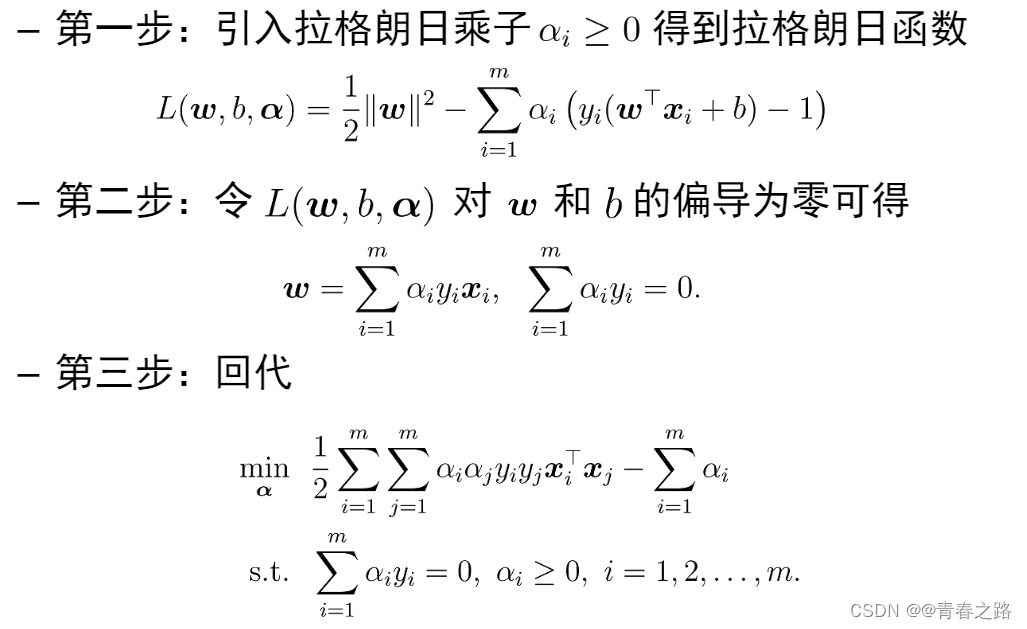

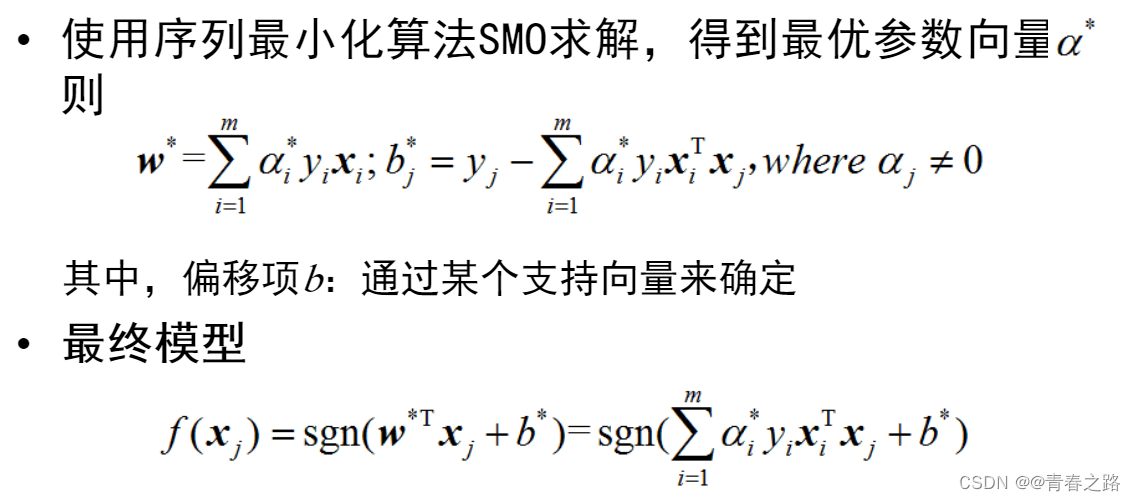

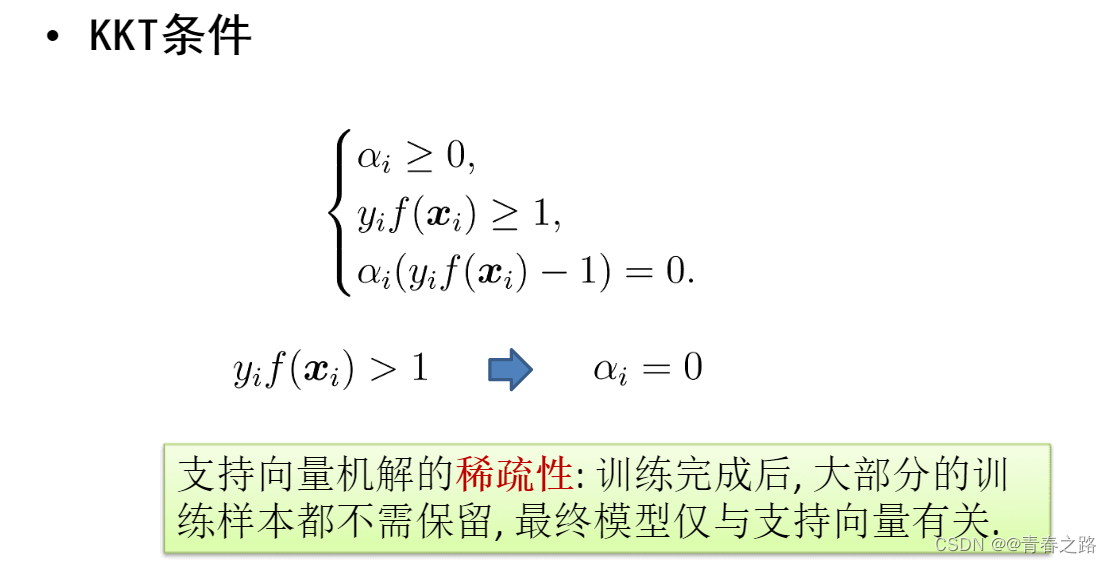

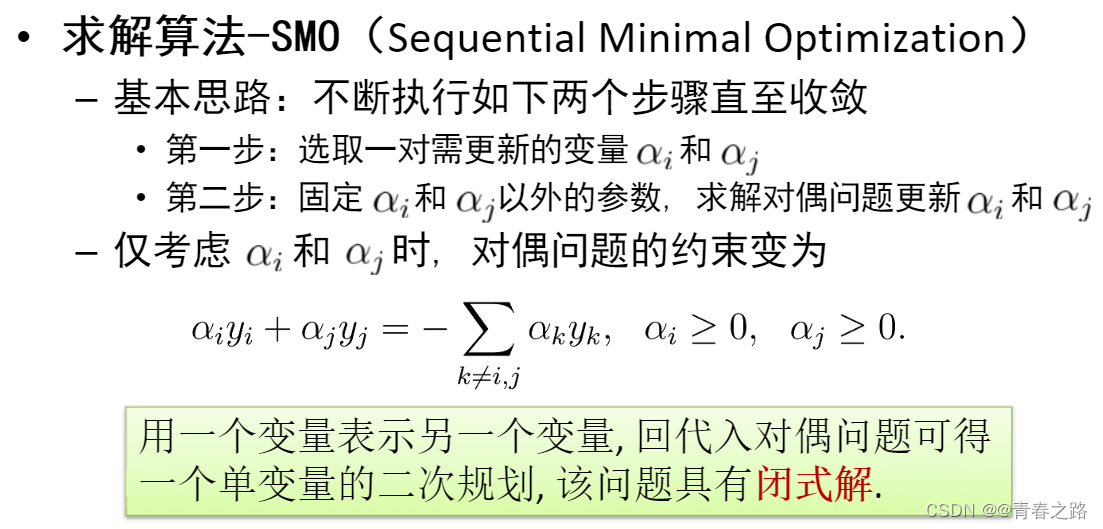

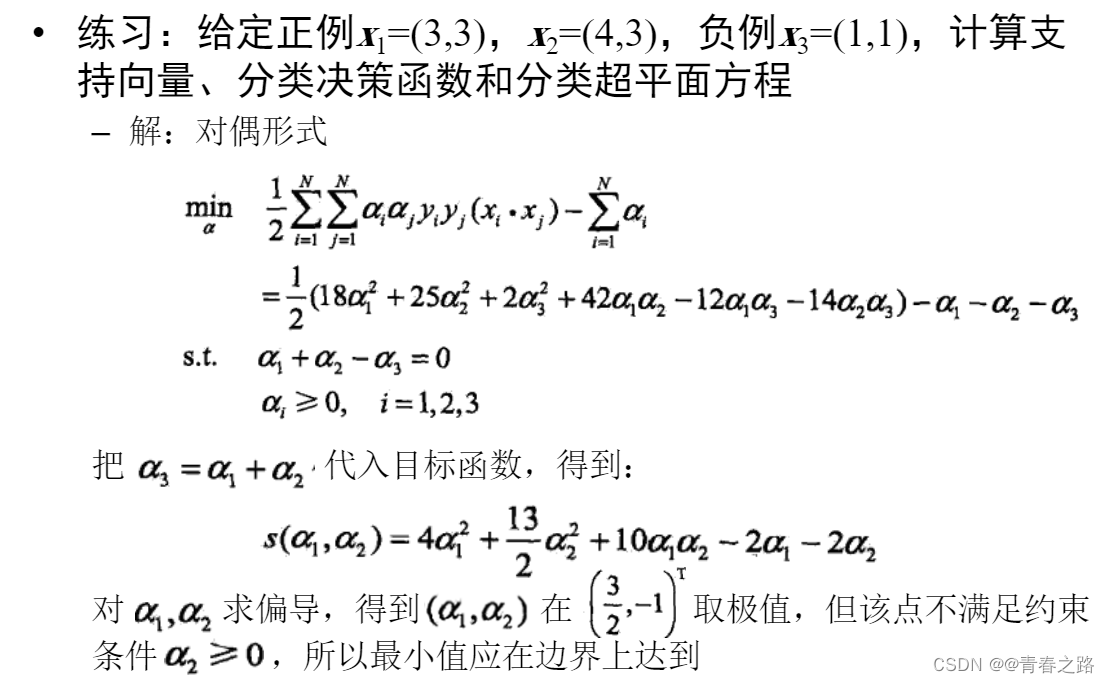

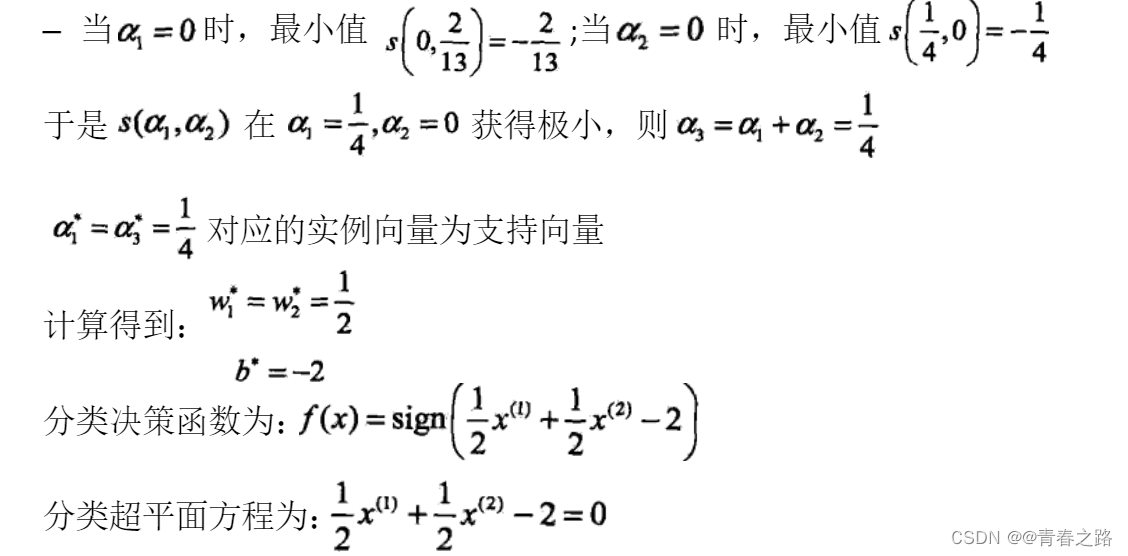

2、线性可分SVM与硬间隔最大化

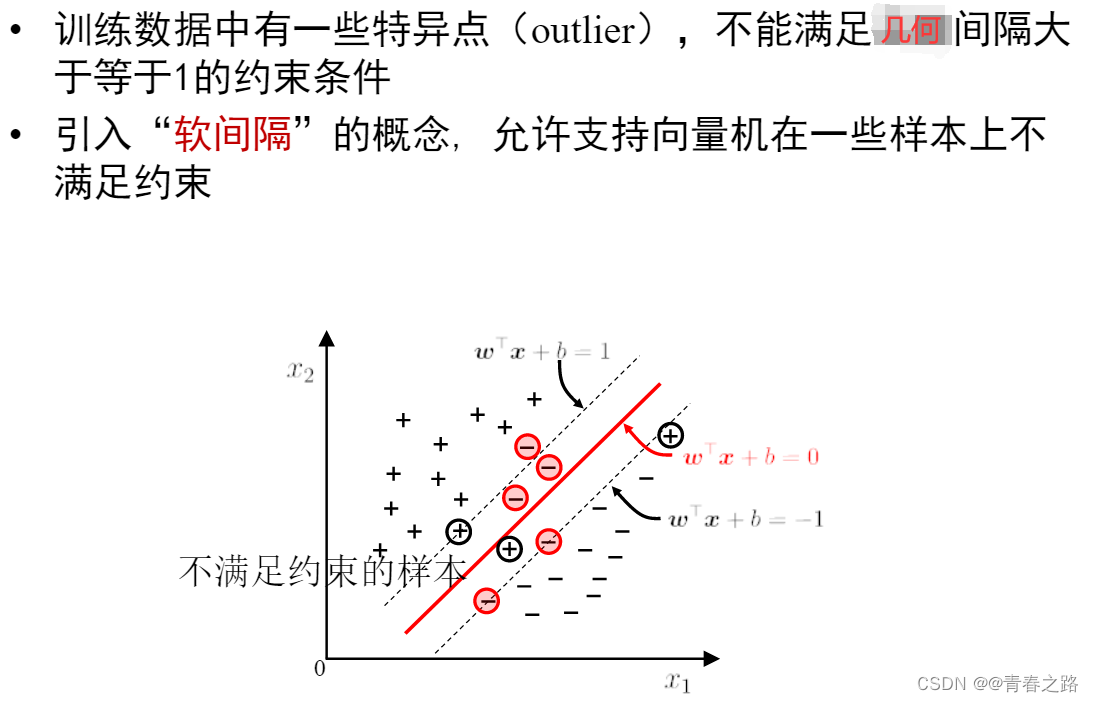

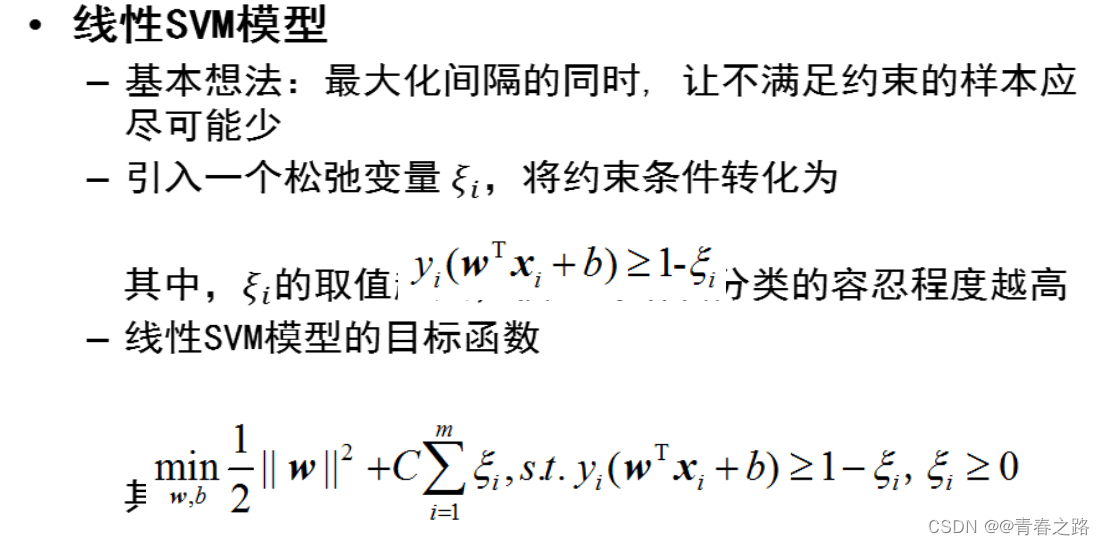

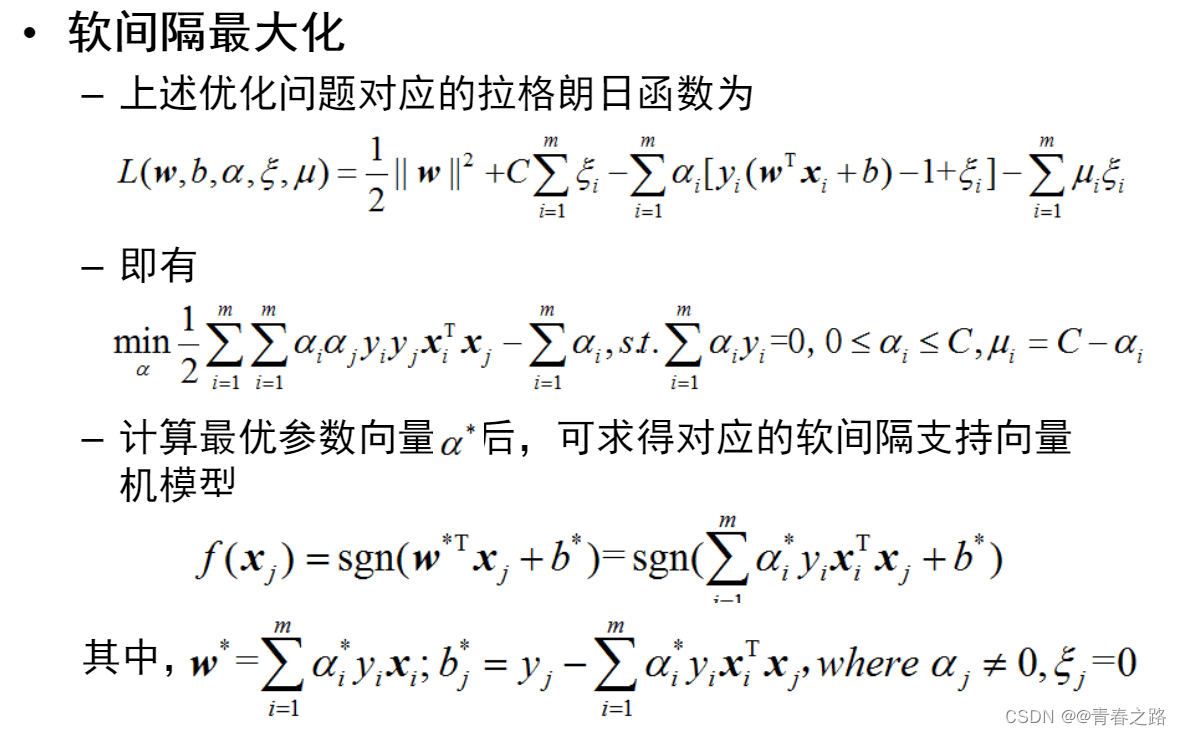

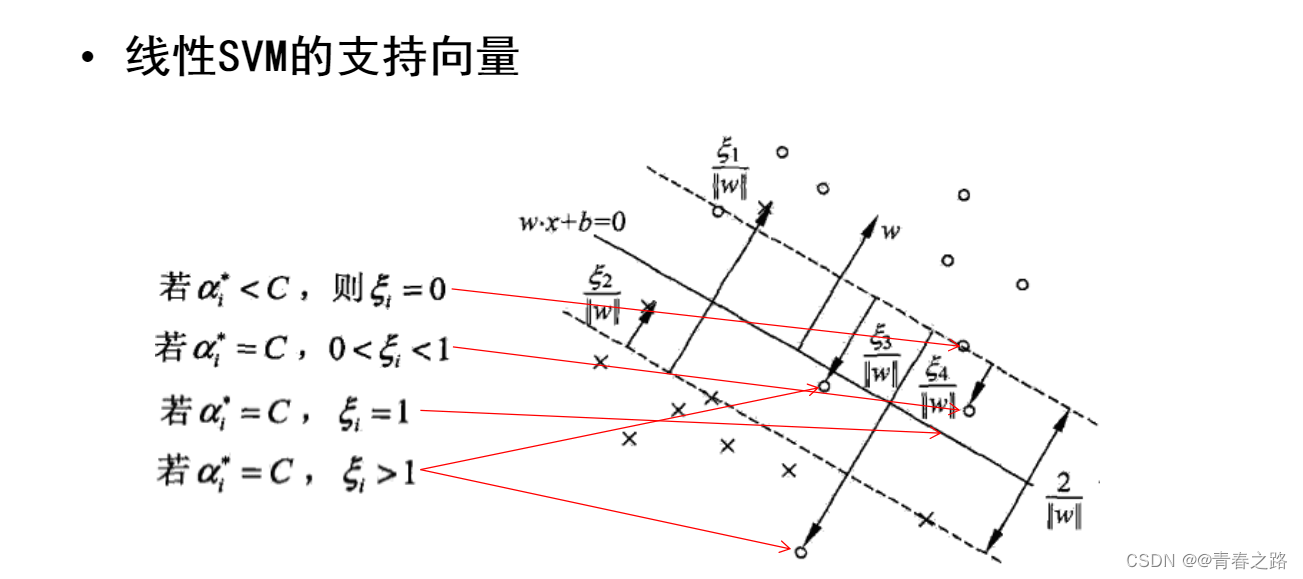

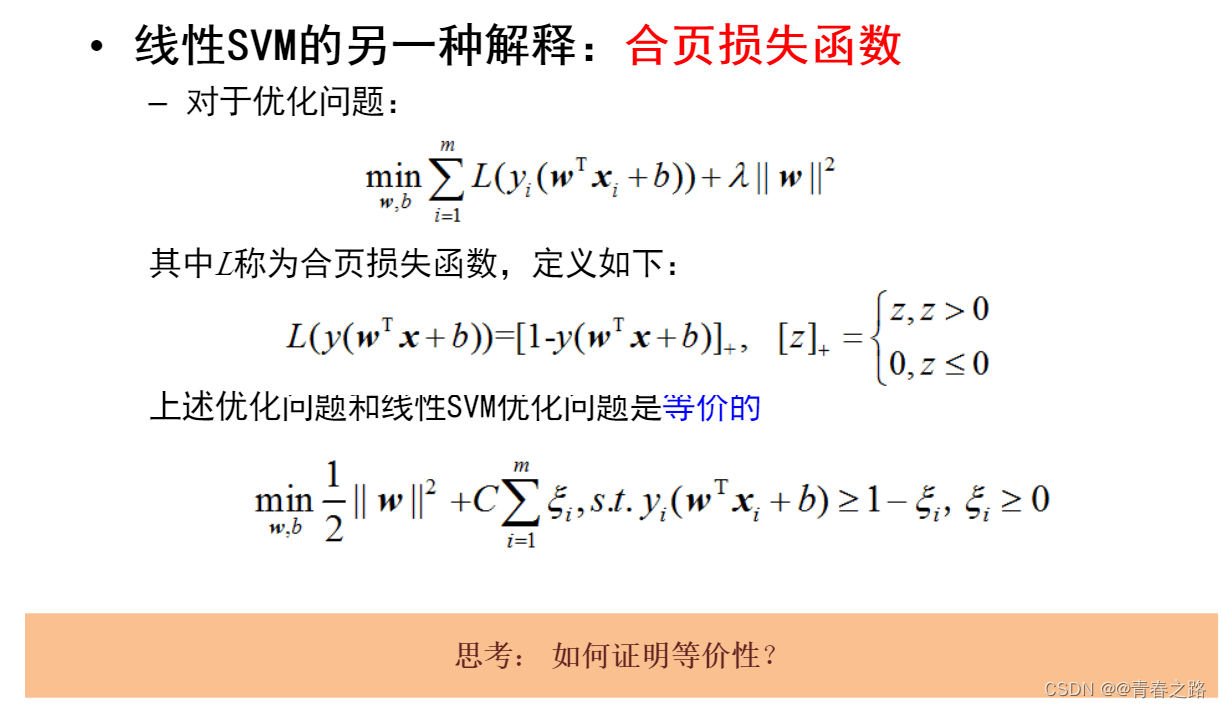

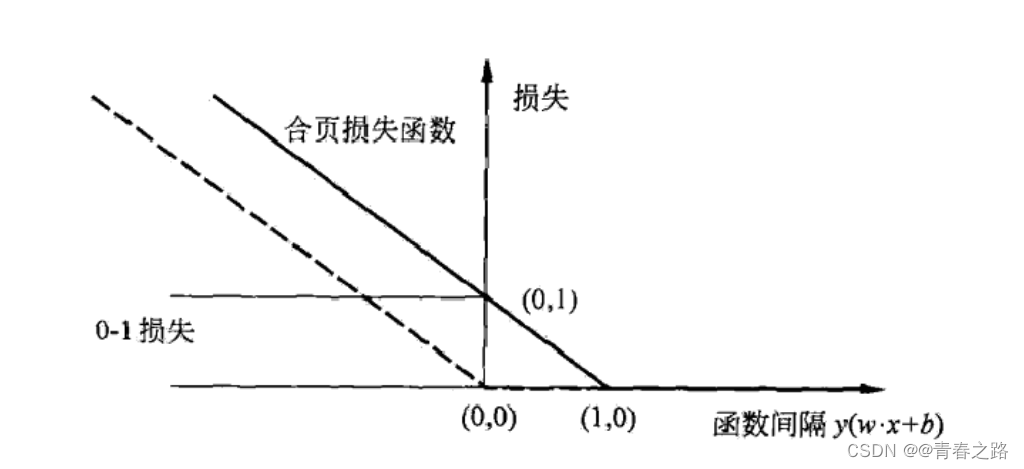

3、线性SVM与软间隔最大化

4、非线性SVM与核函数

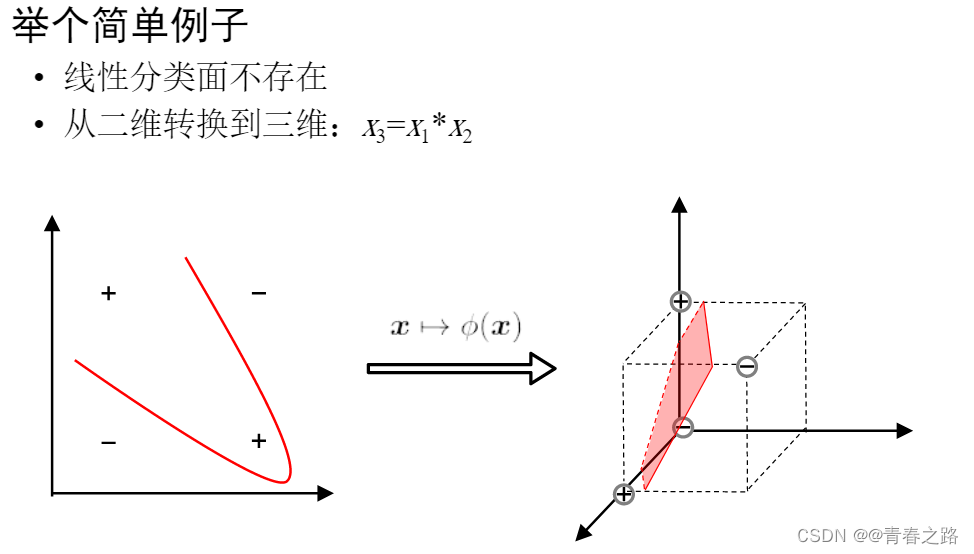

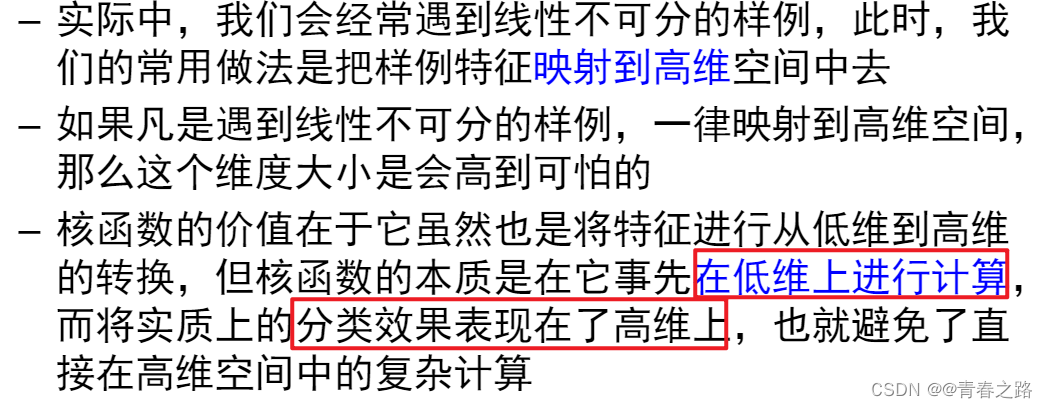

4.1、线性不可分情况

- 若不存在一个能正确划分两类样本的超平面,怎么办?

- 将样本从原始空间映射到一个更高维的特征空间,使得样本在这个特征空间内线性可分

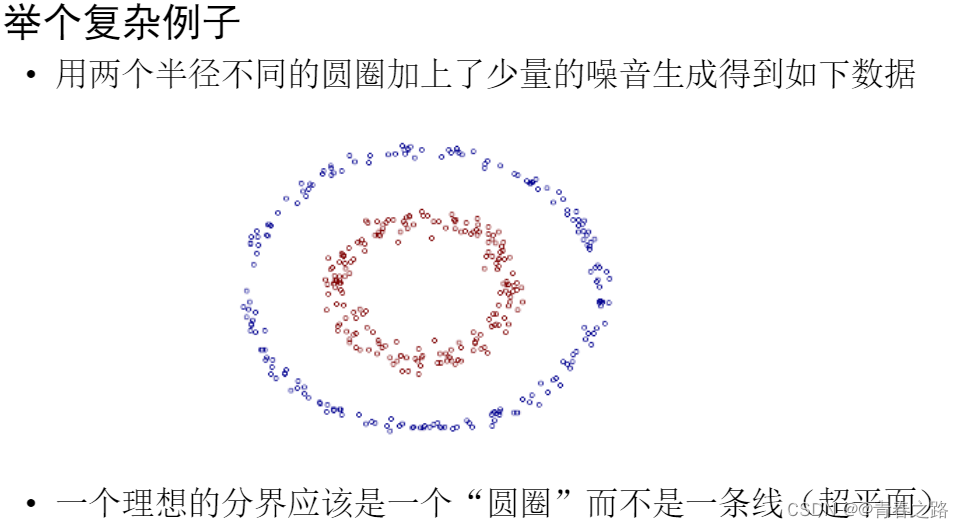

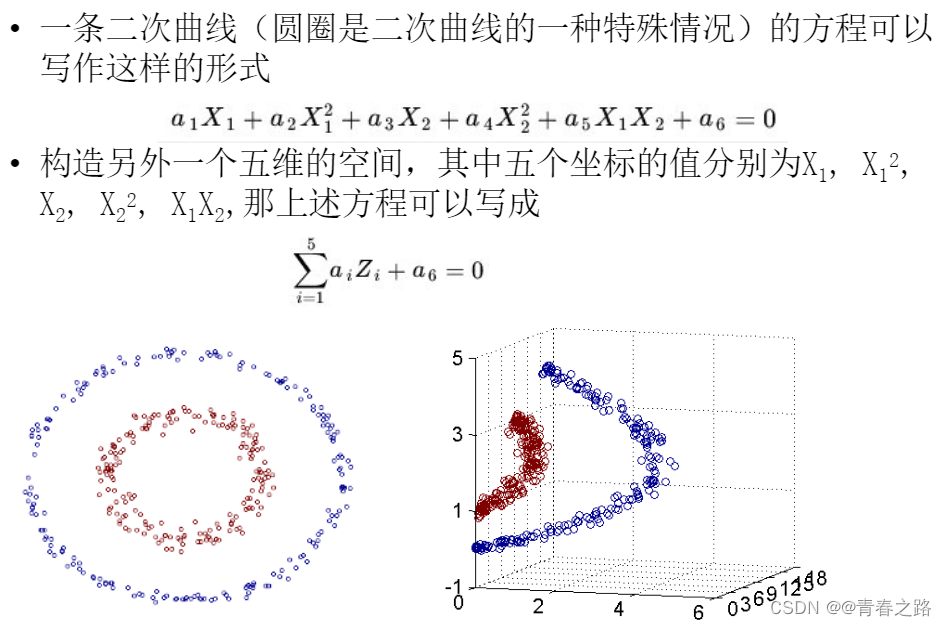

4.2、处理非线性数据

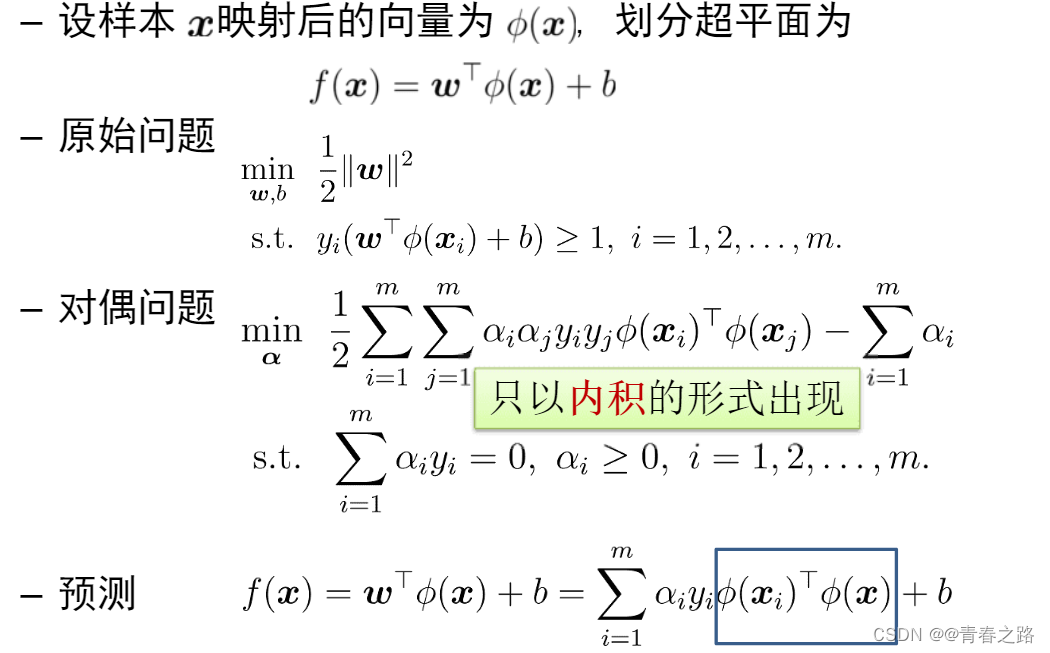

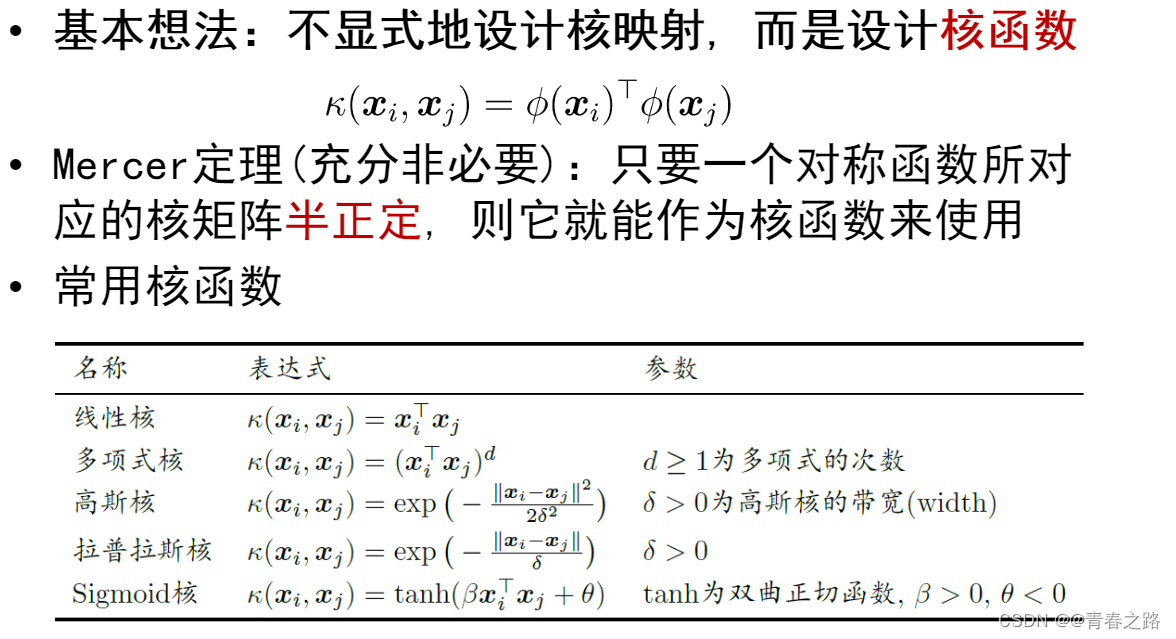

4.3、非线性支持向量机

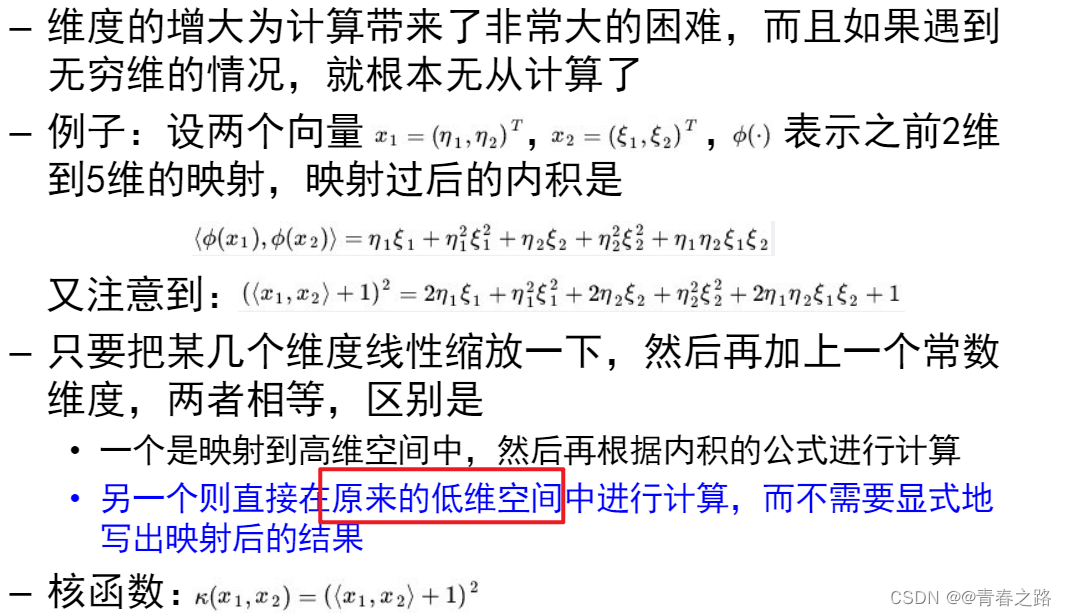

4.4、核函数的本质

版权声明:本文为weixin_41842236原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。