#yarn-spark计算集群搭建-----yarn用于计算资源分配,spark进行计算

1.首先我们们先了解一下yarn: 官方说法就是,任务调度与资源管理 ——分布式资源管理框架。

简单理解以下就是,我们想要计算,而且把很多台计算机连到了一起,但是我们总不能计算的时候让一部分满负荷一部分没事干吧,所以这时候就能体会到yarn的作用了,他会了解以下当前所有计算机的使用情况,然后根据实际情况指挥每台计算机分配多少资源给当前的计算,对,没错,就像一个大将军。

2.我们如何配置一个可用的yarn:

和hdfs模式基本差不多,都是一代多的情况,看下图yarn架构图我们就能看出来,我们要选定一个resourcemanager,然后配置多个nodemanager。

a.系统相关文件配置hosts,hostname,防火墙,Linux之间添加信任:和hdfs的基础配置一致,自行查看

b.yarn-site.xml:

'''

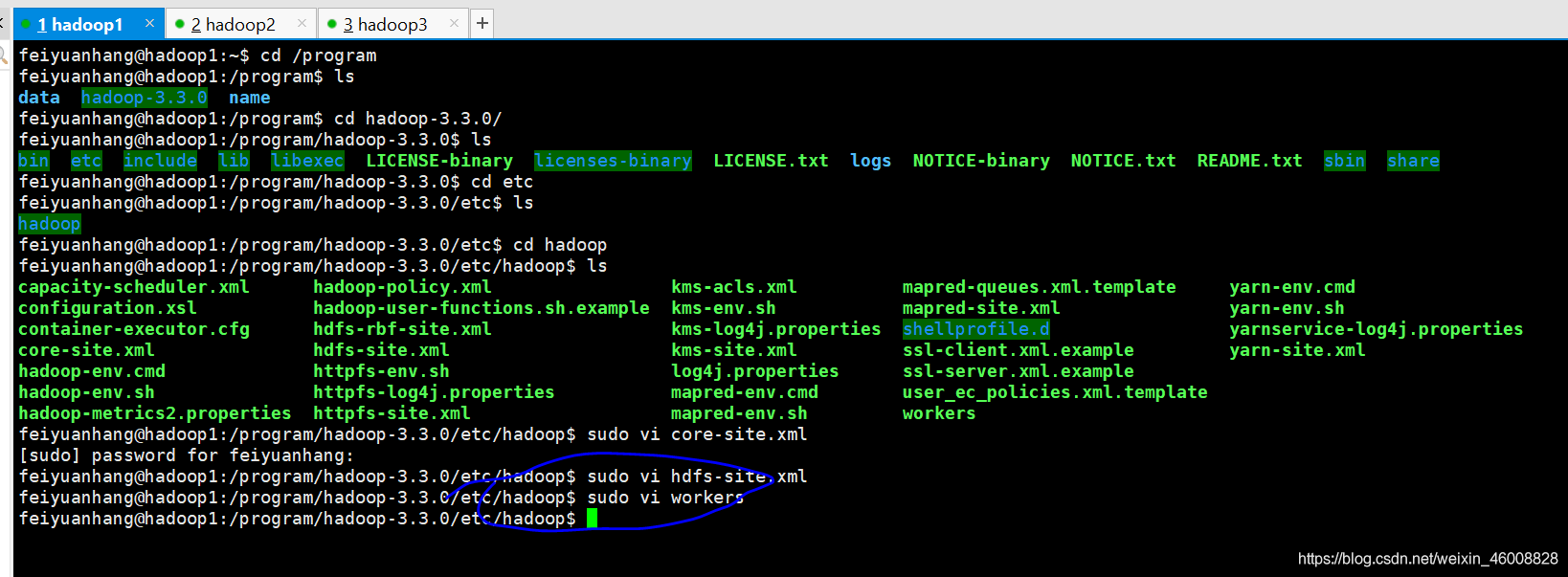

1.我们的hadoop是安装在program下面的,所以我们切换路径:cd /program/hadoop-3.3.0/etc/hadoop

2.修改vi yarn-site.xml文件:yarn.resourcemanager.hostname 是在指定主机是谁:

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop1</value>

</property>

</configuration>

~

'''

c.mapred-site.xml:

'''

1.我们的hadoop是安装在program下面的,所以我们切换路径:cd /program/hadoop-3.3.0/etc/hadoop

2.修改vi mapred-site.xml文件:mapreduce.framework.name是设置用yarn集群进行计算。

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value> #默认是local,不配置走本地多>线程计算

</property>

</configuration>

~

'''

d.workers配置(配置一下集群有几台机器):

'''

1.我们的hadoop是安装在program下面的,所以我们切换路径:cd /program/hadoop-3.3.0/etc/hadoop

2.修改vi workers文件(加入集群里面用户ip):

hadoop1

hadoop2

hadoop3

'''

注:

三台机器的配置是一样的,注意都要配置哟:

3.我们如何验证一个yarn是否好用呢?:

a.首先启动一下yarn:

'''

1.切换路径:cd /program/hadoop-3.3.0/sbin

4.运行命令:./start-yarn.sh 启动yarn ./stop-yarn.sh 停止yarn

5.查看是否启动成功:jps

6.查看Hadoop1:resourcemanager,nodemanager都在,hadoop2/hadoop3:nodemanager存在,就说明启动成功

'''

web端启动后,也可以查看到三台机器:

b.mapreduce执行一个内置计算的例子:

①.数据需要存储在hdfs里面,首先启动好我们的hdfs,没有配置可以查找一下我之前的文章。

②.执行计算语句(如果你的计算机可以计算成功,遇到问题解决问题吧):

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.0.jar wordcount file:///program/hadoop-3.3.0/etc/hadoop/* output "export"

翻译一下就是:查询file:///program/hadoop-3.3.0/etc/hadoop/*路径下下的每个单词数量,保存进export中。

说明:

我没有运行成功,因为我的小笔记本开了三台虚拟机,然后开启了hdfs,继续开启了yarn,简直卡的不行了,没有能力执行计算了。所以以上yarn集群没有异常,试过了,计算行不行不知道,因为卡死机好几次,随之放弃了。

4.安装spark:

a.下载spark,spark下载连接,直接搜官网那个刷不出来,反正我没有刷不出来。

b.安装spark:解压即安装(linux下的模块安装都差不多):

'''

Linux用到的命令:cd(切换路径),mkdir(创建目录),ll(查看文件), cp/mv -i(复制/移动文件),tar(解压),sudo(获得权限,提示你没有权限sudo一下即可),chmod(sudo权限还不够,chmod改一下即可),su(切换用户);

1.切换到root用户:su root 输入密码:xxxxxxx

2.切换到根目录:cd /

3.新建文件夹:mkdir program

4.把Hadoop压缩包导入program,cp(复制)/mv -i(移动)

5.解压即可用:tar -xvzf spark-xxxxx(压缩包名称);

普通用户:sudo tar -xvzf spark-xxxxx即可,需要输入密码;

用root用户进行的到这就安装完了,普通用户总是会有权限方面的事情,不想理会6可以不做的。

6.普通用户使用最好改下文件权限,并进行授权:

a.进行文件目录授权,目的,让普通用户能够访问该目录,执行命令

sudo chmod -R 755 java安装目录

sudo chown -R [username] kafka安装目录

''''

c.运行spark:

'''

1.切换目录:cd /program/spark-3.0.1-bin-hadoop3.2/bin

2.执行./spark-submit --master local --deploy-mode client

'''

持续更新,,,,,,,,,,,,,,

版权声明:本文为weixin_46008828原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。