摘要

该论文方法主要有两步,第一步采用迁移学习思想,对已存在的网络微调最后一层形成特征提取算子提取特征,第二步使用显著性图作为权重将左右视图提取的特征进行融合,额外的再加上多尺度下的视差信息。将以上提取的特征作为训练所用的数据,最后采用SVR进行训练。

介绍

图像质量评价的主要思想是提取能够反映失真水平的特征,传统的方法里主要有以下两种:基于NSS的特征和基于HVS的特征,但是这些都需要花费大量的时间来寻找这些特征。因此这里的论文方法采用基于CNN的特征提取,首先直接将预训练网络应用于IQA中并不高效,因此这里采用预训练网路进行微调,微调后的网络能够很好的应用于3DIQA特征提取中。在利用微调的网络提取特征后再利用显著性信息进行左右视图的特征融合。3D视图还有一个重要的信息是视差信息,因此这里将视差信息也作为最后特征的一部分,最后将以上所有的特征进行SVR训练。

算法框架

算法详解

迁移学习的可行性

预训练网络是从大规模数据集中训练得出的,因此只要使用的数据集不超过特定的领域,微调方法都能取得比较良好的效果。原因: 1、与训练网络能够提取一些通用的特征,如轮廓和边缘等,这些对于失真的情况的测量是有用的;2、IQA的数据集和ImageNet的数据集存在某些相似性。

系统的分析微调CNN

微调所要做的是让CNN的后面层对IQA越来越具体和敏感。具体操作如下:将数据根据MOS值分为六个失真等级,使用全连接网络来代替预训练网络的最后一层,输出为六类。即将输入的失真图像分为六个失真等级。训练微调网络的数据为LIVE2D的数据集,因为2D数据集的MOS值的设置和3D数据集的MOS值原理是一样的,且3D数据集作为测试对象不应包含于训练当中。微调网络训练好后,特征从最后的全连接网络中提取出来,再进行归一化操作作为微调网络提取的特征。

CNN特征融合

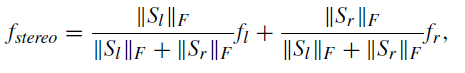

为了满足数目视觉的影响,这里采用显著性引导的特征融合来融合左右视图的特征来形成最终的质量感知特征。显著性图的作用是增强吸引人们注意力的区域并且反应图像的能量分布。结合双目竞争原理,将显著性图作为权重,将左右视图特征进行融合,表达式如下:

多尺度视差特征

视差信息对人类立体视觉感知有重要影响,因为当失真发生时,视差图的统计分布特征将会发生改变。除了CNN提取的特征外,视差信息作为额外的特征来进行训练。

统计特征包括以上几点,均值、方差、峰值和偏离值,这里产生4个特征值,再进行多尺度处理,采取四个尺度,最终该部分形成16个特征。

训练

训练时采用SVR训练,采用5折交叉验证,80%作为训练集,20%作为测试集。

个人感悟

以下发表个人见解:使用迁移学习利用已有的网络进行特征提取个人认为不是很好的创新点,在进行微调时,先将失真图像进行分类训练,这部分算是个创新点,提取了和失真相关的特征。之后再利用显著性图进行特征融合和视差图的统计特征部分在传统算法中感觉已经挺常见的了,不怎么算创新,感觉特征提取部分的分类训练部分是个不错的想法,该想法也可以迁移到训练网络中,在预测时先分类后回归进行训练,有点类似于two stage算法的感觉,以上为个人看法。