1、概述

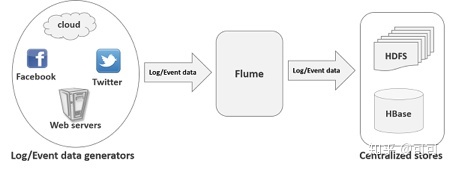

Apache Flume 是一个从可以收集例如日志,事件等数据资源,并将这些数量庞大的数据从各项数据资源中集中起来存储的工具/服务,或者数集中机制。flume具有高可用,分布式,配置工具,其设计的原理也是基于将数据流,如日志数据从各种网站服务器上汇集起来存储到HDFS,HBase等集中存储器中。其结构如下图所示:

2、Flume特性

- Flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统。

- Flume可以采集文件,socket数据包、文件、文件夹、kafka等各种形式源数据,又可以将采集到的数据(下沉sink)输出到HDFS、hbase、hive、kafka等众多外部存储系统中

- 一般的采集需求,通过对flume的简单配置即可实现

- Flume针对特殊场景也具备良好的自定义扩展能力,因此,flume可以适用于大部分的日常数据采集场景

3、下载安装包

官网下载Apache Downloads

目前官方网站已经更新到1.10.1,本安装过程中,采用老版本1.8.0

将安装包上传至 /export/software下

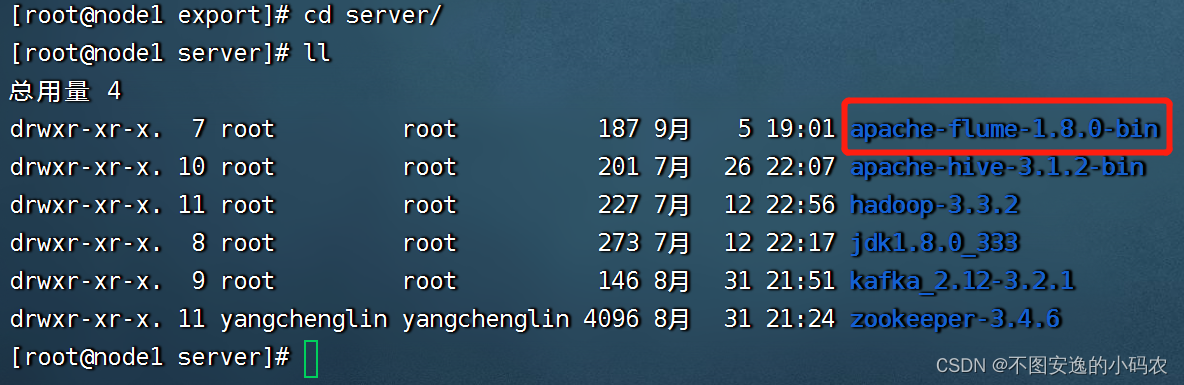

解压安装包至 /export/server

tar -zxvf apache-flume-1.8.0-bin.tar.gz -C ../server/

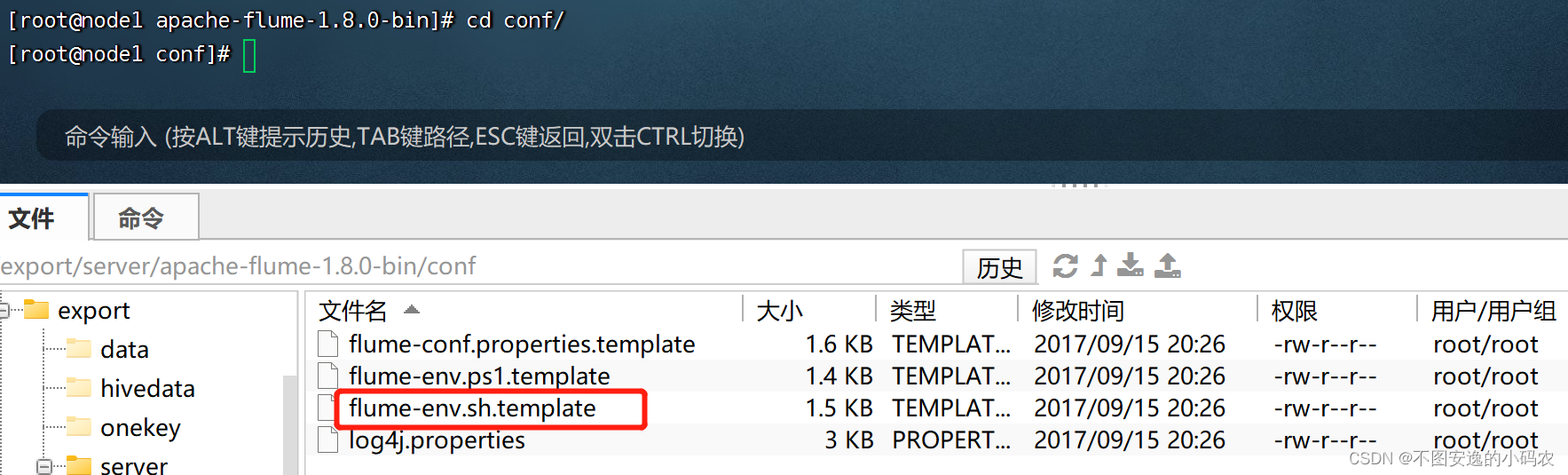

4、配置文件

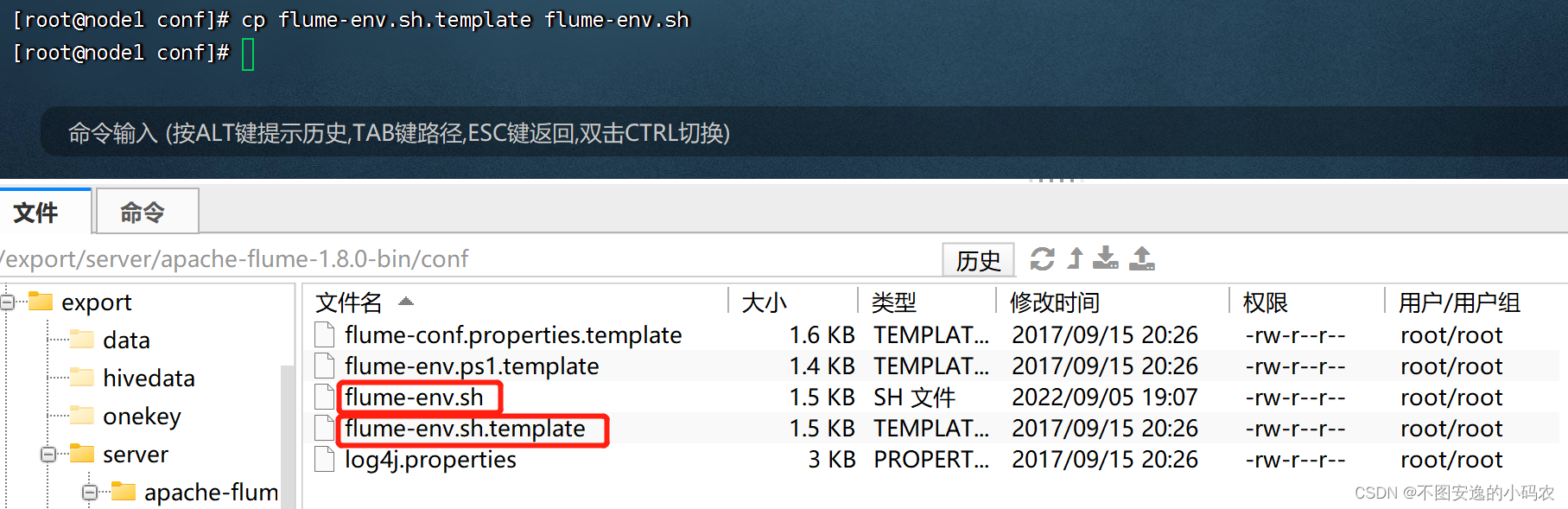

##两条命令都可以,本文第一条

####复制,保留原始文件,并重命名新文件

cp flume-env.sh.template flume-env.sh

####原文件重命名

mv flume-env.sh.template flume-env.sh

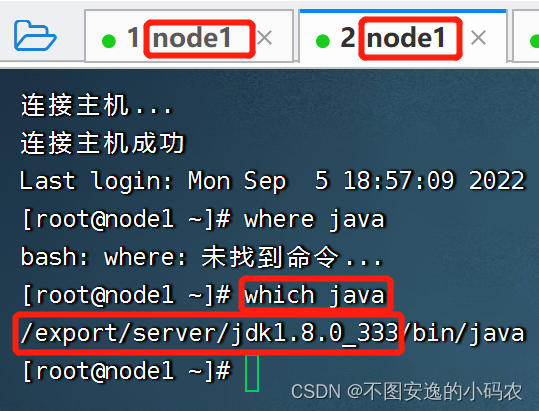

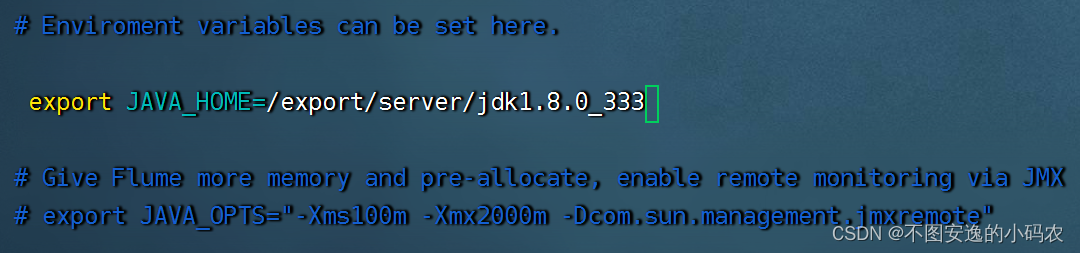

vim flume-env.sh复制窗口执行,查看Java位置

which java

保存退出,

###添加执行权限

chmod a+x flume-env.sh

FLume安装完成

5、测试

在conf文件夹下,新建netcat-logger.conf文件

vim netcat-logger.conf将以下内容复制进文件

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1保存退出,到flume的根目录执行

bin/flume-ng agent --conf conf --conf-file conf/netcat-logger.conf --name a1 -Dflume.root.logger=INFO,console到当前虚拟机的第二个新窗口执行

1)看看是否有telnet

若没有telnet需安装

****************************************

[root@hadoop6 hbase]# telnet localhost 2181

-bash: telnet: 未找到命令

# 查看是否安装了telnet-server服务

[root@hadoop6 hbase]# rpm -qa telnet-server

# 若没有安装,则先安装telnet-server服务

[root@hadoop6 hbase]# yum install telnet-server

# 再安装telnet

[root@hadoop6 hbase]# yum install telnet

*****************************************有telnet的话,任意地址输入

telnet localhost 44444此时输入任何字符,都会以event的数据单元发送,可以在原先的第一个窗口查看

测试完成

版权声明:本文为u010763324原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明。