逆矩阵及伪逆矩阵,最小二乘估计,最小范数估计

逆矩阵的概念

矩阵A的逆矩阵(matrix inversion)记作A − 1 A^{−1}A−1,其定义的矩阵满足如下条件:

A − 1 A = I n A^{−1}A=I_nA−1A=In

我们为什么需要逆矩阵?

我们为什么需要逆矩阵?(从加减乘除的运算角度来解释)

因为矩阵没有被除的概念,矩阵的逆正好是被我们用来解决除法的问题。

例如我们知道矩阵A和矩阵B,并且想要找到矩阵X。

X A = B XA = BXA=B

那最好的方法就是直接除以A(得到X = B / A),但事实上我们不能直接除以矩阵A。

但是我们却可以在公式两边都乘以A − 1 A^{-1}A−1

用矩阵多项式来举例:

样本集X和标签Y,当样本集大小刚好等于X的维度时,可以直接用X的逆矩阵求出权重向量a。

伪逆矩阵和最小二乘估计

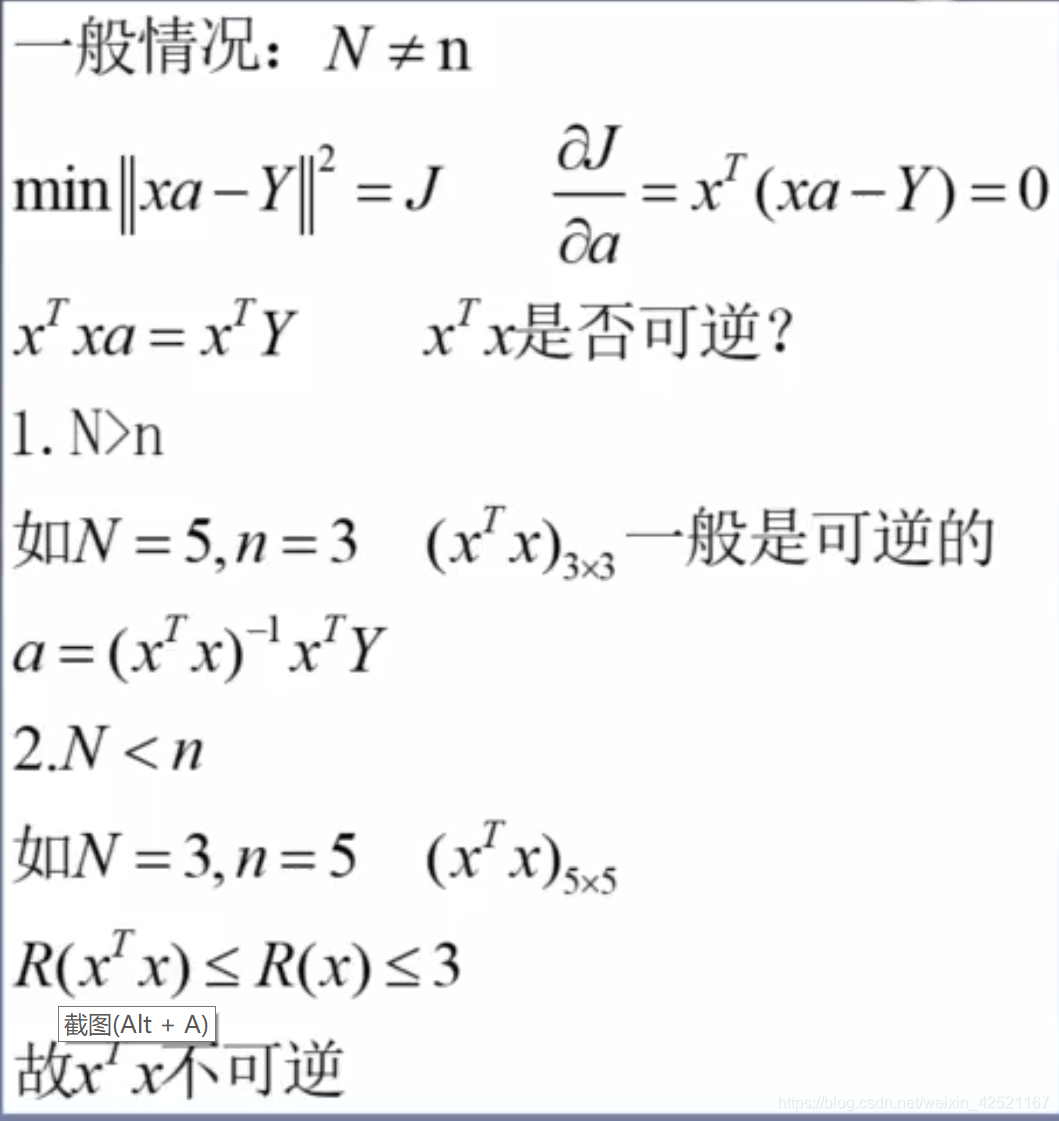

而在一般情况下,样本集大小N都会远大于维度n,那么N ≠ n N \neq nN̸=n时,应该怎么求解a向量,这里引出最小二乘估计的概念:

m i n ∥ x a − Y ∥ 2 = J min\left \| xa-Y \right \|^2=Jmin∥xa−Y∥2=J

对a求最小值:

∂ J ∂ a = x T ( x a − Y ) = 0 \frac{\partial J}{\partial a} = x^T(xa-Y)=0 \\∂a∂J=xT(xa−Y)=0

x T x a = x T Y x^Txa=x^TYxTxa=xTY 此时x T x x^TxxTx是否可逆?

a = ( x T x ) − 1 x T Y a=(x^Tx)^{-1}x^TYa=(xTx)−1xTY 被称为a的伪逆矩阵

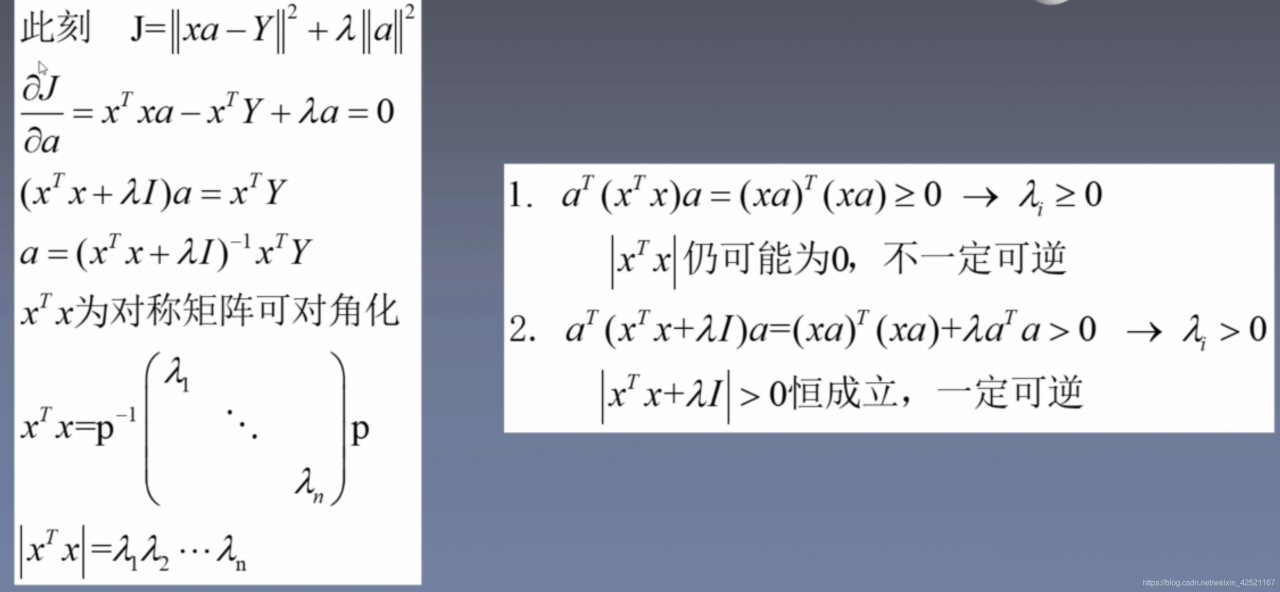

正则化求伪逆矩阵

当N < n N<nN<n,x T x x^TxxTx不可逆时,需通过正则化求伪逆

因为∣ x T x + λ I ∣ > 0 \begin{vmatrix}x^Tx+\lambda I\end{vmatrix}>0∣∣xTx+λI∣∣>0恒成立,故一定可逆

此时λ ∥ a ∥ 2 \lambda\left \| a \right \|^2λ∥a∥2 求值的最小化及最小范数估计